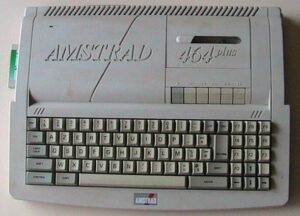

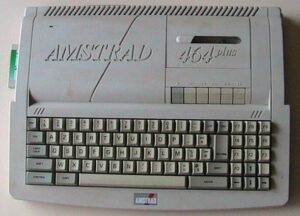

Als der Amstrad CPC 464+ im Jahr 1990 auf den Markt kam, war der Heimcomputermarkt bereits im Umbruch. 16-Bit-Maschinen wie der Commodore Amiga 500 und der Atari ST hatten längst die Fantasie der Entwickler und Spieler erobert, und der klassische 8-Bit-Markt schrumpfte rapide. Dennoch entschloss sich Amstrad unter der Leitung von Sir Alan Sugar dazu, der erfolgreichen CPC-Reihe ein letztes, modernisiertes Update zu verpassen – als Teil einer neuen Generation von Produkten, die mit dem GX4000-Spielsystem eine gemeinsame Hardwarebasis teilen sollten. Der CPC 464+ wurde als direkter Nachfolger des beliebten CPC 464 konzipiert, aber mit einem radikalen Designwechsel, leicht verbesserter Technik und der Möglichkeit, auf moderne Peripheriegeräte und Spiele zuzugreifen. Es war ein Versuch, mit minimalem Aufwand neuen Schwung in die Produktlinie zu bringen und gleichzeitig auf die Spielkonsole GX4000 aufzubauen, die intern dieselbe Hauptplatine verwendete.

Als der Amstrad CPC 464+ im Jahr 1990 auf den Markt kam, war der Heimcomputermarkt bereits im Umbruch. 16-Bit-Maschinen wie der Commodore Amiga 500 und der Atari ST hatten längst die Fantasie der Entwickler und Spieler erobert, und der klassische 8-Bit-Markt schrumpfte rapide. Dennoch entschloss sich Amstrad unter der Leitung von Sir Alan Sugar dazu, der erfolgreichen CPC-Reihe ein letztes, modernisiertes Update zu verpassen – als Teil einer neuen Generation von Produkten, die mit dem GX4000-Spielsystem eine gemeinsame Hardwarebasis teilen sollten. Der CPC 464+ wurde als direkter Nachfolger des beliebten CPC 464 konzipiert, aber mit einem radikalen Designwechsel, leicht verbesserter Technik und der Möglichkeit, auf moderne Peripheriegeräte und Spiele zuzugreifen. Es war ein Versuch, mit minimalem Aufwand neuen Schwung in die Produktlinie zu bringen und gleichzeitig auf die Spielkonsole GX4000 aufzubauen, die intern dieselbe Hauptplatine verwendete.

Der CPC 464+ kostete zum Marktstart rund £199 mit Farbmonitor oder £149 ohne. Inflationsbereinigt entspricht das heute etwa 430 bis 575 Euro. Während das ursprüngliche CPC-Modell ein „All-in-One“-Konzept mit Monitor und eingebautem Laufwerk war, war der 464+ als modernisierter Desktop konzipiert, optisch stark an moderne Konsolen und PCs angelehnt. Die abgerundete Form, das dunkelgraue Gehäuse mit farbigen Funktionstasten und die markante rote Power-Taste erinnerten eher an ein Spielzeug oder eine Konsole als an einen klassischen Heimcomputer. Der eingebaute 3"-Kassettenrekorder war weiterhin vorhanden, obwohl zu diesem Zeitpunkt Kassetten als Speichermedium schon fast veraltet wirkten. Amstrad entschied sich bewusst dafür, um Kompatibilität zur alten CPC-Software zu garantieren und kostengünstig zu bleiben. Optional war ein 3-Zoll-Diskettenlaufwerk nachrüstbar – allerdings nur über spezielle Erweiterungen.

Technisch blieb vieles beim Alten: Der Herzschlag des CPC 464+ war wie beim Vorgänger der Zilog Z80A, ein 8-Bit-Prozessor mit 4 MHz Taktfrequenz. Der Z80 war 1976 entwickelt worden und zeichnete sich durch einen erweiterten Befehlssatz gegenüber dem Intel 8080 aus. Die CPU verfügte über 16-Bit-Adressbus und 8-Bit-Datenbus, was eine Adressierung von bis zu 64 KB direkt möglich machte. Der Befehlssatz bot auch Blockoperationen, ein Bit-Test-System und eine flexible Interrupt Struktur, was ihn besonders für Multitasking-freie Systeme wie Heimcomputer geeignet machte. Zusammen mit dem verbesserten Gate-Array im CPC 464+ wurde es möglich, Bildschirmausgaben effizienter zu verwalten, vor allem im Zusammenspiel mit der neuen DMA-Unterstützung für Sprites und Rastereffekte – allerdings wurden diese Erweiterungen nur von speziell programmierten Spielen ausgenutzt, insbesondere jenen, die auch auf der GX4000 liefen.

Eine der wesentlichen Neuerungen des CPC 464+ war die verbesserte Grafiklogik. Der Rechner unterstützte weiterhin die bekannten drei Bildschirmmodi des CPC: Mode 0 mit 160×200 Pixeln bei 16 Farben, Mode 1 mit 320×200 bei 4 Farben und Mode 2 mit 640×200 bei 2 Farben. Die neue Palette umfasste jetzt 4096 Farben, von denen bis zu 32 gleichzeitig darstellbar waren – vorausgesetzt, das Spiel nutzte die „Plus“-Features. Dies war ein deutliches Upgrade zum alten CPC, dessen Palette nur 27 Farben bot. Allerdings blieben die alten CPC-Spiele auf den alten Grafikmodi beschränkt, da die neue Grafikfähigkeit nicht automatisch aktiviert wurde. Das Bildsignal konnte über RGB oder SCART ausgegeben werden, was eine klare, hochwertige Darstellung auf zeitgenössischen Monitoren oder Fernsehern erlaubte.

Auch der Sound blieb weitgehend unverändert: Der AY-3-8912-Soundchip war erneut an Bord, ein dreistimmiger PSG, der einfache aber ausdrucksstarke Töne produzieren konnte. Theoretisch bot der 464+ durch zusätzliche DMA-Fähigkeiten in Verbindung mit neuen Softwareroutinen eine flexiblere Soundverarbeitung – aber auch hier galt: Nur speziell für die „Plus“-Reihe entwickelte Programme nutzten diese Features wirklich aus. Viele klassische CPC-Spiele liefen einfach im Kompatibilitätsmodus – identisch zu ihren Darstellungen auf dem Original-CPC.

Der Aufbau des CPC 464+ war modularer: Die Tastatur war fest im Gehäuse integriert, aber der Anschluss für Joysticks und Peripheriegeräte war hinter Klappen verborgen – ein Design, das zwar eleganter, aber weniger zugänglich war als beim Original. Der Computer verfügte über einen Erweiterungsport, SCART-Ausgang, Audioausgang und einen analogen Joystickport. Interessanterweise enthielt das neue Plus-Gate-Array Unterstützung für Hardware-Sprites und Raster-Interrupts, was die grafischen Möglichkeiten theoretisch auf Konsolenniveau hob. Einige geplante Peripheriegeräte – wie ein CD-ROM-Laufwerk für den GX4000 oder ein MIDI-Modul – wurden nie fertiggestellt. Die existierende Peripherie umfasste jedoch Drucker, Maus, Lightgun und Speichererweiterungen. Viele dieser Geräte waren kompatibel mit den alten CPCs oder speziell für die GX4000 entwickelt, ließen sich aber auch am CPC 464+ verwenden.

Als Betriebssystem diente weiterhin AMSDOS in Verbindung mit dem Locomotive BASIC 1.1, das in aktualisierter Form leicht angepasst wurde, aber vollständig kompatibel zum ursprünglichen CPC blieb. Die BASIC-Version war weiterhin leistungsfähig, schnell und verfügte über viele eingebaute Grafik- und Soundbefehle. Es war allerdings nicht an die neuen Grafik-Features der Plus-Serie angepasst – wer diese nutzen wollte, musste in Assembler programmieren oder spezielle Entwicklungswerkzeuge verwenden. Diese Einschränkung wurde in mehreren Zeitschriften kritisiert. So schrieb Amstrad Action im November 1990: „Der CPC 464+ sieht aus wie die Zukunft, fühlt sich aber immer noch nach 1984 an, wenn man BASIC startet.“

Die Verkaufszahlen des CPC 464+ waren enttäuschend. Während die ursprüngliche CPC-Serie über drei Millionen Einheiten verkaufte, kamen der 464+ und sein großer Bruder 6128+ zusammen vermutlich auf unter 100.000 Geräte. Der Markt war einfach zu stark auf 16-Bit-Rechner fokussiert, und viele Käufer hielten die neuen Features für Kosmetik. In Frankreich, wo der CPC traditionell stark war, verkaufte sich der 464+ noch relativ gut, vor allem durch Bundle-Angebote mit der GX4000-Konsole. Die Strategie, einen Computer und eine Konsole auf derselben Hardwarebasis zu verkaufen, ging jedoch nicht auf. Ein Bericht in Tilt (Frankreich) vom Dezember 1990 urteilte nüchtern: „Der Plus ist hübsch, aber zu spät. Wäre er 1987 gekommen, hätte er die Szene neu definiert.“

Die Entwickler hinter dem 464+ waren größtenteils dieselben, die bereits am ursprünglichen CPC mitgewirkt hatten. Besonders erwähnenswert ist Cliff Lawson, ein langjähriger technischer Entwickler bei Amstrad, der maßgeblich an der Hardwareintegration und dem Plus-Gate-Array beteiligt war. Lawson äußerte sich später enttäuscht über die geringe Unterstützung durch Softwarehäuser: „Wir gaben ihnen die Tools – aber sie blieben bei Spectrum-Ports mit vier Farben.“

Gegenüber dem Vorgänger CPC 464 bot der CPC 464+ einen moderneren Look, theoretisch bessere Grafik, Sprite- und Raster-Interrupts sowie eine klarere Videoausgabe. Praktisch jedoch war der Mehrwert gering, solange keine Plus-optimierte Software verwendet wurde. Der C64 war zu diesem Zeitpunkt grafisch immer noch konkurrenzfähig – besonders mit der Vielzahl an hochwertigen Spielen – und der Amiga hatte den Markt längst übernommen. Der CPC 464+ wirkte wie ein schöner, aber veralteter Zwischenschritt. Dennoch war er ein würdiger Abschluss der CPC-Reihe: gut verarbeitet, technisch solide und optisch seiner Zeit voraus – aber zu spät erschienen, um noch einen Unterschied zu machen.

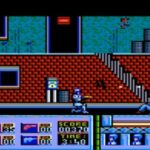

Trotz seiner geringen Verbreitung besitzt der Amstrad CPC 464+ eine kleine, aber bemerkenswerte Sammlung an Spielen, die speziell für die „Plus“-Reihe entwickelt oder angepasst wurden. Diese Titel nutzten in der Regel die erweiterten Grafikfähigkeiten wie Hardware-Sprites, erweiterte Farbpalette und Rastereffekte – Eigenschaften, die auf klassischen CPCs nicht zur Verfügung standen. Viele dieser Spiele erschienen zeitgleich auch für die GX4000-Konsole, da beide Geräte dieselbe technische Basis hatten, was einen reibungslosen Parallelvertrieb erlaubte. Einige dieser Spiele gelten heute als technische Highlights des 8-Bit-Zeitalters auf dem CPC.

Burnin’ Rubber war das vielleicht bekannteste Spiel für den CPC 464+, da es dem Gerät als Bundle beilag und damit praktisch jeder Käufer es besaß. Der rasante Racer erinnerte optisch an OutRun und präsentierte für CPC-Verhältnisse spektakuläre Scrolling-Grafik, schnelle Fahrmanöver und fein aufgelöste Sprites. Es war eines der ersten Spiele, das die erweiterten Plus-Grafikfunktionen wie Farbverläufe, Multiplex-Sprites und Raster-Scrolling aktiv nutzte. Die Musik und die glatte Performance waren ein Paradebeispiel für das, was auf dem CPC technisch möglich war – wenn man die Plus-Features ausschöpfte.

Pang, ursprünglich ein Arcade-Hit von Mitchell und Capcom, wurde von Ocean Software für den CPC Plus portiert. Die Plus-Version unterschied sich deutlich von der regulären CPC-Fassung: Sie bot saubere Arcade-Grafik, weichere Animationen und nutzte die neue Farbpalette intensiv aus. Das Spiel wurde in Zeitschriften wie Amstrad Action als „nahezu arcade-perfect“ bezeichnet. Besonders lobten Kritiker die farbintensive Darstellung und die reaktionsschnelle Steuerung, die nur durch das neue Gate-Array möglich war.

Switchblade, ursprünglich ein Atari ST-Spiel von Gremlin Graphics, erhielt eine exklusive Plus-Version, die mit deutlich besserer Grafik, erweiterten Effekten und optimierter Soundausgabe daherkam. Die Sprites waren detaillierter, es gab farbige Lichtverläufe und rudimentäre Partikeleffekte – ein Showcase für Plus-Technik. Im Vergleich zur regulären CPC-Version wirkte das Spiel wie aus einer anderen Hardwaregeneration. Es wurde in Frankreich in Amstrad Cent Pour Cent besonders positiv besprochen.

Robocop 2, eine Ocean-Produktion, war technisch ambitioniert, wenn auch spielerisch eher solide. Die Plus-Version hatte beeindruckende Hintergründe mit parallaxem Scrolling, Sprite-Multiplexing und Soundeffekte, die über die reguläre AY-Architektur hinausgingen. Auch hier profitierten die Grafiken deutlich vom erweiterten Farbraum der Plus-Reihe.

Barbarian II (Plus Edition) erhielt als eines der wenigen älteren Spiele eine technisch verbesserte „Plus-Version“, die vollständig überarbeitet wurde. Statt nur vier Farben gab es nun kräftige, satte Sprites mit verbesserten Animationen, sowie erweitertes Parallax-Scrolling im Hintergrund. Diese Fassung wurde damals nur als Bundle oder über Spezialhändler vertrieben und ist heute unter Sammlern sehr gesucht.

Navy Seals, ebenfalls von Ocean, war ein später Titel mit düsterem militärischen Szenario, realistischer Sprite-Animation und clever eingesetzten Lichteffekten, die stark von den Rasterfähigkeiten der Plus-Serie Gebrauch machten. Die CPC-Version wurde zwar auch für ältere Modelle vertrieben, doch nur auf dem 464+/6128+ konnten die erweiterten Licht- und Farbverläufe korrekt dargestellt werden.

Einige Demoszenen-Gruppen entwickelten sogar Plus-exklusive Tech-Demos, die nicht als Spiele, sondern als Grafik- und Musikpräsentationen galten. Diese Demos nutzten Hardware-Sprites, Farbrastereffekte und DMA-Sound, um den Plus-Modellen ein Denkmal zu setzen. Gruppen wie Logon System, Benediction und Condense trieben die Maschinen bis an ihre Grenzen.

Insgesamt bleibt festzuhalten: Die Spielebibliothek für den CPC 464+ war klein, aber fein. Was ihr an Quantität fehlte, machte sie oft mit Qualität wett – insbesondere in der grafischen und klanglichen Präsentation. Viele der Plus-Spiele wirken wie ein versäumter Blick in eine alternative Zukunft des CPC: eine Zukunft, in der die Hardware die Software endlich eingeholt hätte. Doch die goldene Zeit war da schon vorbei. Was bleibt, ist ein letzter Glanzmoment der 8-Bit-Ära – konzentriert in wenigen, aber außergewöhnlichen Spielen.

Der Fujitsu FM-7, auch bekannt als „Fujitsu Micro 7“, wurde im November 1982 als kostengünstiger Heimcomputer eingeführt und war eine vereinfachte Version des FM-8. Trotz seiner Positionierung als Einsteigermodell übertraf er seinen Vorgänger in mehreren technischen Aspekten. Während der Entwicklungsphase des FM-7 wurde das Gerät intern als „FM-8 Jr.“ bezeichnet. Es wurden mehrere Prototypen getestet, um die Hardware zu optimieren und die Produktionskosten zu senken. Diese Prototypen führten schließlich zur finalen Version des FM-7, die sich durch ihre Dual-CPU-Architektur und den AY-3-8910 Soundchip auszeichnete.

Der Fujitsu FM-7, auch bekannt als „Fujitsu Micro 7“, wurde im November 1982 als kostengünstiger Heimcomputer eingeführt und war eine vereinfachte Version des FM-8. Trotz seiner Positionierung als Einsteigermodell übertraf er seinen Vorgänger in mehreren technischen Aspekten. Während der Entwicklungsphase des FM-7 wurde das Gerät intern als „FM-8 Jr.“ bezeichnet. Es wurden mehrere Prototypen getestet, um die Hardware zu optimieren und die Produktionskosten zu senken. Diese Prototypen führten schließlich zur finalen Version des FM-7, die sich durch ihre Dual-CPU-Architektur und den AY-3-8910 Soundchip auszeichnete.

Ist denn schon ein Vierteljahrhundert vergangen? Im Jahr 2000 stellte nämlich Logitech die iFeel MouseMan vor und bot damit eine der ersten Computer-Mäuse, die haptisches Feedback integrierten. Er wurde im Herbst 2000 vorgestellt und kombinierte optische Präzision mit der Fähigkeit, taktile Rückmeldungen zu geben. Diese Innovation basierte auf der TouchSense-Technologie von Immersion Corp., die es ermöglichte, physische Empfindungen wie Vibrationen zu erzeugen, wenn der Mauszeiger über bestimmte Bildschirmobjekte bewegt wurde. Ziel war es, die Benutzererfahrung durch den zusätzlichen Sinneseindruck des Tastsinns zu bereichern.

Ist denn schon ein Vierteljahrhundert vergangen? Im Jahr 2000 stellte nämlich Logitech die iFeel MouseMan vor und bot damit eine der ersten Computer-Mäuse, die haptisches Feedback integrierten. Er wurde im Herbst 2000 vorgestellt und kombinierte optische Präzision mit der Fähigkeit, taktile Rückmeldungen zu geben. Diese Innovation basierte auf der TouchSense-Technologie von Immersion Corp., die es ermöglichte, physische Empfindungen wie Vibrationen zu erzeugen, wenn der Mauszeiger über bestimmte Bildschirmobjekte bewegt wurde. Ziel war es, die Benutzererfahrung durch den zusätzlichen Sinneseindruck des Tastsinns zu bereichern.

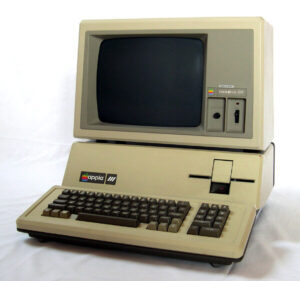

Als Apple im Mai 1980 den Apple III vorstellte, galt er als ambitioniertes Vorhaben, das den erfolgreichen Apple II beerben und das Unternehmen aus dem Heimcomputersegment in den lukrativeren Markt für Business-Computer führen sollte. Die Erwartungen waren immens, denn Apple hatte sich mit dem Apple II als führender Hersteller in der Bildungs- und Hobbyszene etabliert, doch um Unternehmen wie IBM und DEC herauszufordern, musste ein professionelleres Gerät entstehen – leistungsfähiger, robuster und mit echtem Betriebssystem. Der Apple III wurde somit von Anfang an als Business-Maschine positioniert, mit höherem Arbeitsspeicher, besseren Textdarstellungsfähigkeiten und einem professionelleren Gehäuse. Doch die Realität entwickelte sich anders: Der Apple III wurde später berüchtigt als eines der größten Technikdesaster der frühen Computerindustrie.

Als Apple im Mai 1980 den Apple III vorstellte, galt er als ambitioniertes Vorhaben, das den erfolgreichen Apple II beerben und das Unternehmen aus dem Heimcomputersegment in den lukrativeren Markt für Business-Computer führen sollte. Die Erwartungen waren immens, denn Apple hatte sich mit dem Apple II als führender Hersteller in der Bildungs- und Hobbyszene etabliert, doch um Unternehmen wie IBM und DEC herauszufordern, musste ein professionelleres Gerät entstehen – leistungsfähiger, robuster und mit echtem Betriebssystem. Der Apple III wurde somit von Anfang an als Business-Maschine positioniert, mit höherem Arbeitsspeicher, besseren Textdarstellungsfähigkeiten und einem professionelleren Gehäuse. Doch die Realität entwickelte sich anders: Der Apple III wurde später berüchtigt als eines der größten Technikdesaster der frühen Computerindustrie. Als der Amstrad CPC 464+ im Jahr 1990 auf den Markt kam, war der Heimcomputermarkt bereits im Umbruch. 16-Bit-Maschinen wie der Commodore Amiga 500 und der Atari ST hatten längst die Fantasie der Entwickler und Spieler erobert, und der klassische 8-Bit-Markt schrumpfte rapide. Dennoch entschloss sich Amstrad unter der Leitung von Sir Alan Sugar dazu, der erfolgreichen CPC-Reihe ein letztes, modernisiertes Update zu verpassen – als Teil einer neuen Generation von Produkten, die mit dem GX4000-Spielsystem eine gemeinsame Hardwarebasis teilen sollten. Der CPC 464+ wurde als direkter Nachfolger des beliebten

Als der Amstrad CPC 464+ im Jahr 1990 auf den Markt kam, war der Heimcomputermarkt bereits im Umbruch. 16-Bit-Maschinen wie der Commodore Amiga 500 und der Atari ST hatten längst die Fantasie der Entwickler und Spieler erobert, und der klassische 8-Bit-Markt schrumpfte rapide. Dennoch entschloss sich Amstrad unter der Leitung von Sir Alan Sugar dazu, der erfolgreichen CPC-Reihe ein letztes, modernisiertes Update zu verpassen – als Teil einer neuen Generation von Produkten, die mit dem GX4000-Spielsystem eine gemeinsame Hardwarebasis teilen sollten. Der CPC 464+ wurde als direkter Nachfolger des beliebten  Der Amstrad CPC (Colour Personal Computer), eine Heimcomputer-Serie aus Großbritannien, wurde 1984 von Amstrad unter der Leitung von Alan Michael Sugar veröffentlicht. Die Serie war Amstrads Antwort auf die Dominanz von Commodore, Sinclair und Acorn im britischen Heimcomputermarkt der frühen 1980er Jahre. Sugar, ein britischer Unternehmer aus einfachen Verhältnissen, hatte sich bis dahin mit billigen Stereoanlagen und Haushaltsgeräten einen Namen gemacht. Mit dem CPC wollte er in den expandierenden Heimcomputermarkt einsteigen, allerdings mit einer radikal anderen Herangehensweise: statt einem nackten Motherboard wie beim Sinclair

Der Amstrad CPC (Colour Personal Computer), eine Heimcomputer-Serie aus Großbritannien, wurde 1984 von Amstrad unter der Leitung von Alan Michael Sugar veröffentlicht. Die Serie war Amstrads Antwort auf die Dominanz von Commodore, Sinclair und Acorn im britischen Heimcomputermarkt der frühen 1980er Jahre. Sugar, ein britischer Unternehmer aus einfachen Verhältnissen, hatte sich bis dahin mit billigen Stereoanlagen und Haushaltsgeräten einen Namen gemacht. Mit dem CPC wollte er in den expandierenden Heimcomputermarkt einsteigen, allerdings mit einer radikal anderen Herangehensweise: statt einem nackten Motherboard wie beim Sinclair

FTL Games war ein kleines, aber äußerst einflussreiches Softwareunternehmen aus Kalifornien, das mit seinem dritten Produkt die Landschaft der Computerrollenspiele für immer verändern sollte. Ursprünglich firmierte die Firma unter dem Namen Software Heaven, gegründet von Wayne Holder und Russ Boelhauf in San Diego. Anfangs konzentrierte man sich auf sogenannte Utility-Software wie Rechtschreibprüfprogramme, die teils im Eigenvertrieb, teils im Auftrag anderer Firmen vertrieben wurden. Doch Wayne Holder hatte schon früh den Wunsch, neben der „seriösen“ Software auch Unterhaltungstitel zu entwickeln. Um diesem Vorhaben einen strukturellen Rahmen zu geben, rief er die Abteilung FTL ins Leben, deren Name für „Faster Than Light“ stand – ein passender Titel für ein Studio, das bald zum Pionier der Echtzeit-Rollenspiele werden sollte.

FTL Games war ein kleines, aber äußerst einflussreiches Softwareunternehmen aus Kalifornien, das mit seinem dritten Produkt die Landschaft der Computerrollenspiele für immer verändern sollte. Ursprünglich firmierte die Firma unter dem Namen Software Heaven, gegründet von Wayne Holder und Russ Boelhauf in San Diego. Anfangs konzentrierte man sich auf sogenannte Utility-Software wie Rechtschreibprüfprogramme, die teils im Eigenvertrieb, teils im Auftrag anderer Firmen vertrieben wurden. Doch Wayne Holder hatte schon früh den Wunsch, neben der „seriösen“ Software auch Unterhaltungstitel zu entwickeln. Um diesem Vorhaben einen strukturellen Rahmen zu geben, rief er die Abteilung FTL ins Leben, deren Name für „Faster Than Light“ stand – ein passender Titel für ein Studio, das bald zum Pionier der Echtzeit-Rollenspiele werden sollte. Zu den ersten Mitarbeitern zählte Bruce Webster, ein alter Schulfreund von Wayne Holder, der auch prompt die Leitung der neuen Spieleabteilung übernahm. Mit „SunDog: Frozen Legacy“ erschien 1984 das erste Spiel des Studios, zunächst für den Apple II, nur wenige Wochen später gefolgt von einer verbesserten Version 1.1. SunDog war ein ambitioniertes Handels- und Abenteuerspiel im Science-Fiction-Setting, das durch seine offene Spielwelt, Kampfelemente und eine relativ komplexe Spielmechanik hervorstach. Es war bemerkenswert stabil und ambitioniert für seine Zeit – und das in einer Ära, in der Patchkultur und Updates noch kein Standard waren. Als SunDog im Dezember 1985 für den Atari ST portiert wurde, erhielt es eine völlig überarbeitete Grafik und mehrere spielmechanische Verbesserungen. Die Portierung übernahm der frisch zu FTL gestoßene Doug Bell, der zuvor gemeinsam mit Andy Jaros am Titel „Crystal Dragon“ gearbeitet hatte – einem Projekt, das später als „Dungeon Master“ Weltruhm erlangen sollte. Bruce Webster dagegen verließ das Unternehmen kurz nach der Fertigstellung von SunDog – er war, wie er später zugab, von der intensiven Entwicklung ausgelaugt und wollte sich von der Branche zurückziehen.

Zu den ersten Mitarbeitern zählte Bruce Webster, ein alter Schulfreund von Wayne Holder, der auch prompt die Leitung der neuen Spieleabteilung übernahm. Mit „SunDog: Frozen Legacy“ erschien 1984 das erste Spiel des Studios, zunächst für den Apple II, nur wenige Wochen später gefolgt von einer verbesserten Version 1.1. SunDog war ein ambitioniertes Handels- und Abenteuerspiel im Science-Fiction-Setting, das durch seine offene Spielwelt, Kampfelemente und eine relativ komplexe Spielmechanik hervorstach. Es war bemerkenswert stabil und ambitioniert für seine Zeit – und das in einer Ära, in der Patchkultur und Updates noch kein Standard waren. Als SunDog im Dezember 1985 für den Atari ST portiert wurde, erhielt es eine völlig überarbeitete Grafik und mehrere spielmechanische Verbesserungen. Die Portierung übernahm der frisch zu FTL gestoßene Doug Bell, der zuvor gemeinsam mit Andy Jaros am Titel „Crystal Dragon“ gearbeitet hatte – einem Projekt, das später als „Dungeon Master“ Weltruhm erlangen sollte. Bruce Webster dagegen verließ das Unternehmen kurz nach der Fertigstellung von SunDog – er war, wie er später zugab, von der intensiven Entwicklung ausgelaugt und wollte sich von der Branche zurückziehen. Noch bevor sich FTL ganz auf Dungeon Master konzentrierte, erschien 1987 mit „Oids“ ein weiteres Spiel für den Atari ST, das auf der Physik klassischer Trägheitssteuerung basierte, wie man sie aus Titeln wie Gravitar oder Thrust kannte. Spieler steuerten ein kleines Raumschiff, das Roboter aus Gefangenschaft befreien sollte. Trotz minimalistischer Handlung entwickelte sich Oids, besonders in Großbritannien, zu einem Kultspiel. Die spätere Macintosh-Version hingegen blieb hinter den Erwartungen zurück, obwohl sie auf der MacWorld 1990 mit fünf Sternen bewertet wurde – mangels Marketings geriet sie schnell in Vergessenheit.

Noch bevor sich FTL ganz auf Dungeon Master konzentrierte, erschien 1987 mit „Oids“ ein weiteres Spiel für den Atari ST, das auf der Physik klassischer Trägheitssteuerung basierte, wie man sie aus Titeln wie Gravitar oder Thrust kannte. Spieler steuerten ein kleines Raumschiff, das Roboter aus Gefangenschaft befreien sollte. Trotz minimalistischer Handlung entwickelte sich Oids, besonders in Großbritannien, zu einem Kultspiel. Die spätere Macintosh-Version hingegen blieb hinter den Erwartungen zurück, obwohl sie auf der MacWorld 1990 mit fünf Sternen bewertet wurde – mangels Marketings geriet sie schnell in Vergessenheit. Das Ziel war von Anfang an klar: Dungeon Master, wie Crystal Dragon nun hieß, sollte mit den großen Vorbildern Ultima, Wizardry und The Bard’s Tale konkurrieren – und sie, wenn möglich, übertreffen. Inspiriert von den Stärken dieser Klassiker, schufen Bell und Jaros ein System, das die Rollenspielmechanik grundlegend erneuerte. Die Dungeon-Welt war in Echtzeit, statt in Runden erlebbar. Dies war zwar nicht neu, wurde doch bereits Dungeons von Daggorath 1982 auf dem TRS-80 Color Computer in dieser Weise präsentiert. Was Dungeon Master jedoch besonders machte, war die vollständige Integration von Echtzeitkämpfen, Bewegungen, Magie und Sound in einem 3D-ähnlichen Dungeon, zusammen mit Maussteuerung und einem Skillsystem, das auf Anwendung beruhte. Zaubersprüche wurden über Symbolkombinationen aus den vier Elementen konstruiert, Fähigkeiten durch wiederholte Nutzung verbessert statt über punktuelle Levelaufstiege. Die Benutzeroberfläche war vollständig mit der Maus bedienbar, und das Sounddesign – samt dynamischer Lichteffekte – sorgte für ungeahnte Immersion. Die Geschichte der Spielwelt, aufgeschrieben von Nancy Holder, Waynes Frau, wurde im Handbuch ausgiebig beschrieben und lieferte eine dichte Atmosphäre. Nancy Holder machte sich später auch als Autorin von Romanen zu Serien wie „Buffy“, „Sabrina“ und „Smallville“ einen Namen.

Das Ziel war von Anfang an klar: Dungeon Master, wie Crystal Dragon nun hieß, sollte mit den großen Vorbildern Ultima, Wizardry und The Bard’s Tale konkurrieren – und sie, wenn möglich, übertreffen. Inspiriert von den Stärken dieser Klassiker, schufen Bell und Jaros ein System, das die Rollenspielmechanik grundlegend erneuerte. Die Dungeon-Welt war in Echtzeit, statt in Runden erlebbar. Dies war zwar nicht neu, wurde doch bereits Dungeons von Daggorath 1982 auf dem TRS-80 Color Computer in dieser Weise präsentiert. Was Dungeon Master jedoch besonders machte, war die vollständige Integration von Echtzeitkämpfen, Bewegungen, Magie und Sound in einem 3D-ähnlichen Dungeon, zusammen mit Maussteuerung und einem Skillsystem, das auf Anwendung beruhte. Zaubersprüche wurden über Symbolkombinationen aus den vier Elementen konstruiert, Fähigkeiten durch wiederholte Nutzung verbessert statt über punktuelle Levelaufstiege. Die Benutzeroberfläche war vollständig mit der Maus bedienbar, und das Sounddesign – samt dynamischer Lichteffekte – sorgte für ungeahnte Immersion. Die Geschichte der Spielwelt, aufgeschrieben von Nancy Holder, Waynes Frau, wurde im Handbuch ausgiebig beschrieben und lieferte eine dichte Atmosphäre. Nancy Holder machte sich später auch als Autorin von Romanen zu Serien wie „Buffy“, „Sabrina“ und „Smallville“ einen Namen. Angesichts dieses Erfolgs war eine Fortsetzung unausweichlich. Während ein Team an der vereinfachten Fassung „Dungeon Master: Theron’s Quest“ für die TurboGrafx arbeitete, begann die Hauptentwicklung an „Dungeon Master II“. Wie schon bei früheren Projekten zog sich die Entwicklung jedoch über Jahre hin – sechs Jahre, um genau zu sein. 1993 erschien das Spiel zunächst exklusiv in Japan, der Rest der Welt musste bis 1995 warten. Die Portierung gestaltete sich deutlich schwieriger als beim ersten Teil, nicht zuletzt wegen der stark voneinander abweichenden Hardware: Während der Amiga mit 32 Farben arbeitete, verfügte ein VGA-PC über 256 Farben. Erschienen ist das Spiel unter anderem für Mega-CD, FM Towns und PC-98.

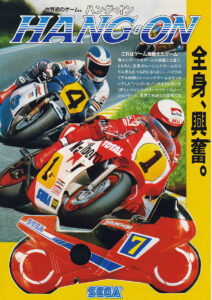

Angesichts dieses Erfolgs war eine Fortsetzung unausweichlich. Während ein Team an der vereinfachten Fassung „Dungeon Master: Theron’s Quest“ für die TurboGrafx arbeitete, begann die Hauptentwicklung an „Dungeon Master II“. Wie schon bei früheren Projekten zog sich die Entwicklung jedoch über Jahre hin – sechs Jahre, um genau zu sein. 1993 erschien das Spiel zunächst exklusiv in Japan, der Rest der Welt musste bis 1995 warten. Die Portierung gestaltete sich deutlich schwieriger als beim ersten Teil, nicht zuletzt wegen der stark voneinander abweichenden Hardware: Während der Amiga mit 32 Farben arbeitete, verfügte ein VGA-PC über 256 Farben. Erschienen ist das Spiel unter anderem für Mega-CD, FM Towns und PC-98. Hang-On, veröffentlicht 1985 von Sega, war so gänzlich anders als bisherige Arcade Automaten, sowohl sowohl technologisch als auch kreativ. Das Motorradrennspiel entstand unter der Leitung von Yu Suzuki, einem Entwickler, der nicht nur für sein technisches Gespür, sondern auch für seine Leidenschaft für Autos und Motorräder bekannt war. Nachdem ein Kollege ihm den Vorschlag gemacht hatte, einen Torsionsstab – ein flexibles mechanisches Bauteil zur Richtungssteuerung – in ein Spiel zu integrieren, war Suzuki sofort fasziniert von der Idee, ein realistisches Fahrgefühl in ein Arcade-Spiel zu bringen. Obwohl sich die Verwendung des Torsionsstabs als zu kompliziert herausstellte, fand er mit einfachen, aber effektiven Federn eine praktikable Alternative, die das Neigen eines echten Motorrads simulierte.

Hang-On, veröffentlicht 1985 von Sega, war so gänzlich anders als bisherige Arcade Automaten, sowohl sowohl technologisch als auch kreativ. Das Motorradrennspiel entstand unter der Leitung von Yu Suzuki, einem Entwickler, der nicht nur für sein technisches Gespür, sondern auch für seine Leidenschaft für Autos und Motorräder bekannt war. Nachdem ein Kollege ihm den Vorschlag gemacht hatte, einen Torsionsstab – ein flexibles mechanisches Bauteil zur Richtungssteuerung – in ein Spiel zu integrieren, war Suzuki sofort fasziniert von der Idee, ein realistisches Fahrgefühl in ein Arcade-Spiel zu bringen. Obwohl sich die Verwendung des Torsionsstabs als zu kompliziert herausstellte, fand er mit einfachen, aber effektiven Federn eine praktikable Alternative, die das Neigen eines echten Motorrads simulierte.

Wer als Kind nicht Räuber und Gendarm oder Cowboy und Indianer gespielt hatte, war in seiner Kindheit wohl völlig isoliert in der westlichen Welt aufgewachen. Wieso also nicht dieses Filmprinzip für ein Videospiel adaptieren?

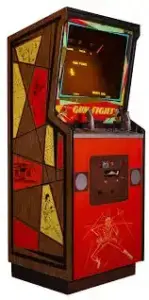

Wer als Kind nicht Räuber und Gendarm oder Cowboy und Indianer gespielt hatte, war in seiner Kindheit wohl völlig isoliert in der westlichen Welt aufgewachen. Wieso also nicht dieses Filmprinzip für ein Videospiel adaptieren? Die spielerische Grundlage von Western Gun beruhte auf dem elektromechanischen Spiel Gun Fight, das bereits 1969 von Sega veröffentlicht worden war. In diesem früheren Spiel standen sich zwei Cowboys auf einer beweglichen Bahn gegenüber, getrennt durch ein Feld mit Kakteen, Bäumen und einem Saloon. Beim Abschuss auf Kakteen neigten sich deren Spitzen vorübergehend, während ein Treffer den Cowboy kurzzeitig zu Fall brachte. Ziel war es, den Gegner innerhalb eines vorgegebenen Zeitrahmens möglichst oft zu treffen, um Punkte zu sammeln. Nishikado übernahm dieses Grundkonzept, passte es jedoch für den Videospielbereich an, indem er Hindernisse wie Felsen hinzufügte, von denen Kugeln abprallen konnten, und zerstörbare Kakteen integrierte, die visuell zerfielen, wenn sie getroffen wurden. Technisch setzte er dabei auf Transistor-Transistor-Logik (TTL), da der Einsatz von Mikroprozessoren in der Spieleentwicklung noch nicht etabliert war. Aufgrund seiner vielfältigen Interaktionsmöglichkeiten und der komplexen Spiellogik zählt Western Gun zu den aufwendigsten TTL-Spielen der 1970er Jahre.

Die spielerische Grundlage von Western Gun beruhte auf dem elektromechanischen Spiel Gun Fight, das bereits 1969 von Sega veröffentlicht worden war. In diesem früheren Spiel standen sich zwei Cowboys auf einer beweglichen Bahn gegenüber, getrennt durch ein Feld mit Kakteen, Bäumen und einem Saloon. Beim Abschuss auf Kakteen neigten sich deren Spitzen vorübergehend, während ein Treffer den Cowboy kurzzeitig zu Fall brachte. Ziel war es, den Gegner innerhalb eines vorgegebenen Zeitrahmens möglichst oft zu treffen, um Punkte zu sammeln. Nishikado übernahm dieses Grundkonzept, passte es jedoch für den Videospielbereich an, indem er Hindernisse wie Felsen hinzufügte, von denen Kugeln abprallen konnten, und zerstörbare Kakteen integrierte, die visuell zerfielen, wenn sie getroffen wurden. Technisch setzte er dabei auf Transistor-Transistor-Logik (TTL), da der Einsatz von Mikroprozessoren in der Spieleentwicklung noch nicht etabliert war. Aufgrund seiner vielfältigen Interaktionsmöglichkeiten und der komplexen Spiellogik zählt Western Gun zu den aufwendigsten TTL-Spielen der 1970er Jahre.