Intel 4004

Von Stelo.xyz, Pttn, or Thomas Nguyen

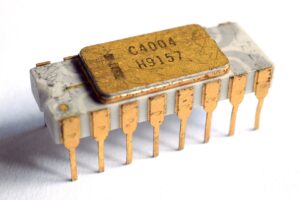

Im Herbst des Jahres 1971, während die Welt mit dem Vietnamkrieg, der beginnenden Watergate-Affäre und der Apollo-15-Mission beschäftigt war, veröffentlichte ein damals noch recht junges Unternehmen namens Intel ein unscheinbares Stück Silizium, das alles verändern sollte: den Intel 4004. Kaum größer als ein Fingernagel oder schwerer als eine Büroklammer– aber dieses kleine, rechteckige Wunderding war der erste kommerzielle Mikroprozessor der Welt. Und damit die Geburt des modernen Computers in Taschenformat.

Doch wie kam es dazu, dass ausgerechnet Intel, bis dahin ein Halbleiterhersteller für RAM-Chips, plötzlich zum Taktgeber einer ganzen Industrie wurde? Der Ursprung der Geschichte liegt nicht etwa im kalifornischen Silicon Valley, sondern in Japan. Dort hatte das Unternehmen Busicom – ein Hersteller von Taschenrechnern – ein Problem. Man wollte eine neue Serie von programmierbaren Rechenmaschinen entwickeln, doch die herkömmliche Methode, jeden Taschenrechner mit einer individuellen Chipkombination auszustatten, war zu teuer und zu umständlich. Die Japaner wandten sich also an Intel und baten um die Fertigung von 12 maßgeschneiderten Chips für ihre Rechner. Doch einer im Intel-Team hatte eine bessere Idee.

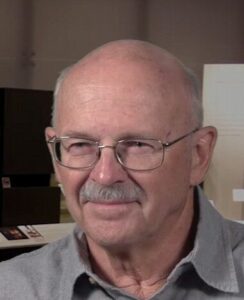

Dieser jemand war Ted Hoff, ein junger Elektroingenieur, der 1968 als einer der ersten Mitarbeiter bei Intel angeheuert wurde. Hoff erkannte, dass man statt vieler spezialisierter Chips auch einen einzigen universell programmierbaren Chip entwickeln könnte, der die Steuerung sämtlicher Rechenprozesse übernehmen konnte – ein revolutionärer Gedanke. Gemeinsam mit Stan Mazor, einem Kollegen aus der Softwareentwicklung, entwickelte Hoff die Grundstruktur eines Chips, der Daten verarbeiten, Rechenbefehle verstehen und Programme ausführen konnte. Diese Idee landete schließlich auf dem Schreibtisch des genialen Chipdesigners Federico Faggin, einem Italiener, der zuvor bei Fairchild an den ersten Silizium-Gate-MOS-Transistoren gearbeitet hatte. Faggin setzte das Konzept um, optimierte das Design und entwarf die finale Architektur des 4004 – inklusive Testverfahren und Layout.

Der Intel 4004 wurde 1971 veröffentlicht – und war im Grunde ein kompletter Prozessor in Miniaturform. Er arbeitete mit 4 Bit Wortbreite, konnte maximal 0,06 MIPS (Millionen Instruktionen pro Sekunde) leisten und verfügte über 2.300 Transistoren – was heute lächerlich klingt, damals aber geradezu futuristisch war. Der Chip lief mit einer Taktfrequenz von 740 kHz, wobei der interne Befehlstakt durch einen Teilungsfaktor auf ca. 92 kHz reduziert wurde. Der Speicherzugriff erfolgte über ein externes ROM- und RAM-System – der Prozessor selbst enthielt keine Adressverwaltung. Dennoch: Für einfache Anwendungen wie Taschenrechner, Steuergeräte und primitive Terminals war das völlig ausreichend.

Der 4004 wurde im Bundle mit drei Begleitchips verkauft – einem ROM (4001), einem RAM (4002) und einem I/O-Controller (4003). Der Preis für den Prozessor allein lag damals bei etwa 60 US-Dollar. Inflationsbereinigt entspricht das heute rund 420 Euro. In der Herstellung kostete der Chip Intel jedoch nur etwa 15 bis 20 US-Dollar – was einem heutigen Preis von knapp 130 Euro entspräche. Ein gutes Geschäft also, vor allem wenn man bedenkt, dass Intel nach anfänglichem Zögern die exklusiven Rechte von Busicom zurückkaufte und den 4004 öffentlich vermarkten durfte.

Obwohl der 4004 nie für Personal Computer oder gar Konsolen eingesetzt wurde – dafür war er zu schwach und zu speziell – fand er schnell Einzug in industrielle Anwendungen. In Ampelsteuerungen, Kassensystemen, Labormessgeräten oder Automaten diente der 4004 als digitale Steuerzentrale. Der Durchbruch in den Heimcomputermarkt kam dann erst mit seinem großen Bruder, dem 8-Bit-Prozessor Intel 8080, der unter anderem im Altair 8800 und später im Z80-kompatiblen Heimcomputerwesen eine entscheidende Rolle spielte.

Was die Konkurrenz anging: Fairchild, Motorola und Texas Instruments arbeiteten ebenfalls an integrierten Schaltungen, doch keiner hatte zu diesem Zeitpunkt ein so funktionsfähiges, programmierbares System auf einem einzigen Chip realisiert. Texas Instruments beanspruchte später für sich, vor Intel einen Mikroprozessor entwickelt zu haben – das Modell TMS1000 –, doch der wurde erst 1974 serienmäßig verbaut. Intel hatte das Rennen gemacht. Punkt.

Federico Faggin, der das Projekt letztlich federführend technisch realisierte, sollte später als Vater des Mikroprozessors gefeiert werden. Er gründete später die Firma Zilog, die mit dem Z80-Prozessor selbst Geschichte schrieb. Ted Hoff wurde Vizepräsident bei Atari und war maßgeblich an der Entwicklung von Heimcomputern beteiligt. Stan Mazor blieb Intel treu und arbeitete an weiteren Architekturen. Alle drei wurden für ihre Pionierleistung mehrfach ausgezeichnet, darunter mit der National Medal of Technology.

In der Rückschau bleibt festzuhalten: Der Intel 4004 war nicht der leistungsfähigste Chip seiner Zeit, aber er war der erste, der das Konzept des Allzweckprozessors in den Massenmarkt brachte. „Es war, als hätte jemand dem Rechenschieber Beine gegeben“, sagte Faggin später lachend in einem Interview. Und diese Beine liefen weit. Ohne den 4004 kein IBM-PC, kein Smartphone, keine Smartwatch, kein Mars-Rover. Ein Siliziumstein, der eine Lawine auslöste. Wer hätte das 1971 gedacht, als in einer kleinen Anzeige im Electronic News schlicht stand: „Introducing the 4004 – a microprogrammable computer on a chip.“ Der Rest ist Geschichte – und was für eine.

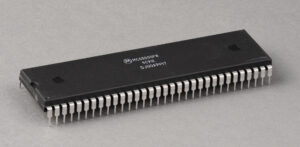

Der TMS9900 wurde 1976 als einer der ersten Ein-Chip-16-Bit-Mikroprozessoren vorgestellt. Er basierte auf der Architektur des TI-990-Minicomputers und übertrug dessen leistungsfähige 16-Bit-Designprinzipien auf einen einzelnen N-MOS-Chip. Mit etwa 3100 Gattern (rund 8000 Transistoren) und einer Taktfrequenz bis 3 MHz war der TMS9900 seinerzeit technologisch beeindruckend. Während viele 8-Bit-Konkurrenten wie der MOS 6502 noch mit rund 1 MHz takten mussten, hoffte Texas Instruments auf einen frühen Sprung in das 16-Bit-Zeitalter. Und tatsächlich war der TMS9900 der erste kommerzielle 16-Bit-Mikroprozessor auf dem Markt. Doch der Vorsprung wurde nicht zum Triumph. Einer der TI-Manager, Walden C. Rhines, kommentierte Jahre später selbstkritisch: „Obwohl dieser Hund von einem Chip im ersten 16-Bit-Heimcomputer der Welt eingesetzt wurde, hat ihn kaum jemand je wahrgenommen. Die Geschichte wird eben von den Gewinnern geschrieben.“

Der TMS9900 wurde 1976 als einer der ersten Ein-Chip-16-Bit-Mikroprozessoren vorgestellt. Er basierte auf der Architektur des TI-990-Minicomputers und übertrug dessen leistungsfähige 16-Bit-Designprinzipien auf einen einzelnen N-MOS-Chip. Mit etwa 3100 Gattern (rund 8000 Transistoren) und einer Taktfrequenz bis 3 MHz war der TMS9900 seinerzeit technologisch beeindruckend. Während viele 8-Bit-Konkurrenten wie der MOS 6502 noch mit rund 1 MHz takten mussten, hoffte Texas Instruments auf einen frühen Sprung in das 16-Bit-Zeitalter. Und tatsächlich war der TMS9900 der erste kommerzielle 16-Bit-Mikroprozessor auf dem Markt. Doch der Vorsprung wurde nicht zum Triumph. Einer der TI-Manager, Walden C. Rhines, kommentierte Jahre später selbstkritisch: „Obwohl dieser Hund von einem Chip im ersten 16-Bit-Heimcomputer der Welt eingesetzt wurde, hat ihn kaum jemand je wahrgenommen. Die Geschichte wird eben von den Gewinnern geschrieben.“

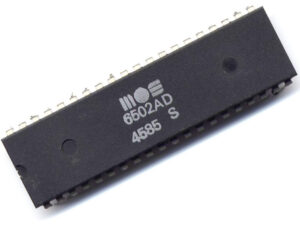

Der Zilog Z80A ist ein 8-Bit-Mikroprozessor, der im Juli 1976 von Zilog auf den Markt gebracht wurde. Federico Faggin, der zuvor bei Intel an der Entwicklung des 8080 beteiligt war, gründete gemeinsam mit Ralph Ungermann das Unternehmen Zilog und entwickelte den Z80 als verbesserten und binär kompatiblen Nachfolger des Intel 8080. Der Z80A war eine Weiterentwicklung des ursprünglichen Z80 und bot eine höhere Taktfrequenz von 4 MHz. Technisch zeichnete sich der Z80A durch eine erweiterte Befehlssatzarchitektur aus, die zusätzliche Instruktionen und Adressierungsmodi umfasste. Er verfügte über 8-Bit-Daten- und 16-Bit-Adressbusse, wodurch er bis zu 64 KB Speicher adressieren konnte. Ein bemerkenswertes Merkmal war die Integration von dynamischen RAM-Refresh-Schaltungen, die den Einsatz von dynamischem Speicher erleichterten. Die interne Architektur umfasste mehrere Registerpaare (BC, DE, HL) sowie Indexregister (IX, IY) und ermöglichte so flexible Datenmanipulationen.

Der Zilog Z80A ist ein 8-Bit-Mikroprozessor, der im Juli 1976 von Zilog auf den Markt gebracht wurde. Federico Faggin, der zuvor bei Intel an der Entwicklung des 8080 beteiligt war, gründete gemeinsam mit Ralph Ungermann das Unternehmen Zilog und entwickelte den Z80 als verbesserten und binär kompatiblen Nachfolger des Intel 8080. Der Z80A war eine Weiterentwicklung des ursprünglichen Z80 und bot eine höhere Taktfrequenz von 4 MHz. Technisch zeichnete sich der Z80A durch eine erweiterte Befehlssatzarchitektur aus, die zusätzliche Instruktionen und Adressierungsmodi umfasste. Er verfügte über 8-Bit-Daten- und 16-Bit-Adressbusse, wodurch er bis zu 64 KB Speicher adressieren konnte. Ein bemerkenswertes Merkmal war die Integration von dynamischen RAM-Refresh-Schaltungen, die den Einsatz von dynamischem Speicher erleichterten. Die interne Architektur umfasste mehrere Registerpaare (BC, DE, HL) sowie Indexregister (IX, IY) und ermöglichte so flexible Datenmanipulationen.

In den 1970er Jahren hatte sich Intel mit seinen Prozessoren, allen voran dem Intel 8008 und dem späteren 8080, einen guten Ruf erarbeitet. Der Intel 8080 war das Herzstück vieler frühe Personal Computer und das Betriebssystem CP/M wurde ursprünglich für diesen Prozessor entwickelt, was ihm eine breite Nutzerbasis verschaffte. Doch die Konkurrenz holte schnell auf: Zilog hatte mit dem

In den 1970er Jahren hatte sich Intel mit seinen Prozessoren, allen voran dem Intel 8008 und dem späteren 8080, einen guten Ruf erarbeitet. Der Intel 8080 war das Herzstück vieler frühe Personal Computer und das Betriebssystem CP/M wurde ursprünglich für diesen Prozessor entwickelt, was ihm eine breite Nutzerbasis verschaffte. Doch die Konkurrenz holte schnell auf: Zilog hatte mit dem