Von All About Apple museum official web site - http://www.allaboutapple.com

Der Apple IIgs wurde im September 1986 zum zehnjährigen Firmenjubiläum von Apple vorgestellt und gilt als Höhepunkt der Apple-II-Reihe. Er kombinierte die vertraute Apple‑II‐Kompatibilität mit deutlich verbesserten Multimediafähigkeiten – das „gs“ steht für Graphics und Sound. Als Einführungspreis wurden 999 US‑Dollar festgesetzt (ohne Monitor), was heute inflationsbereinigt etwa 2.500 € entsprechen würde. Zum Lieferumfang gehörte ein 3,5″-Diskettenlaufwerk, jedoch kein Monitor. Die ersten rund zehntausend produzierten Geräte waren als „Woz Edition“ bekannt und trugen auf der Front das eingravierte Autogramm von Apple-II-Erfinder Steve Wozniak – ein Hinweis darauf, wie sehr Apple diesen Computer als legitimen Nachfolger des legendären Apple II positionieren wollte. Die Apple-II-Gemeinde reagierte begeistert; so zeigte das Magazin inCider im Oktober 1986 einen strahlenden Wozniak auf dem Cover mit der Schlagzeile „It’s Amazing!“ (übersetzt etwa: „Es ist unglaublich!“).

Die Entwicklung des Apple IIgs begann unter dem Codenamen „Phoenix“ (Phönix), passend zum Motto eines wiederauferstandenen Apple II. Mitte der 1980er war der Umsatz des Apple II trotz des Erfolgs des Macintosh immer noch bedeutend, insbesondere im Bildungsbereich. Ein Team erfahrener Apple‑II-Ingenieure drängte daher auf eine Modernisierung der inzwischen in die Jahre gekommenen Plattform. Den technologischen Anstoß lieferte der neue WDC 65816/65C816–Prozessor der Western Design Center, ein 16-Bit-Nachfolger des klassischen 6502. Dieser Chip konnte im sogenannten Emulationsmodus alle Befehle des 8-Bit-6502 ausführen und zugleich dank 24-Bit-Adressbus bis zu 16 MB Speicher ansprechen. Als Apple-Mitgründer Steve Wozniak 1983 nach längerer Auszeit ins Unternehmen zurückkehrte, begeisterte er sich sofort für die Möglichkeiten dieses Chips. Wozniak, der den Original-Apple‑II konstruiert hatte, setzte sich dafür ein, den neuen Rechner einfach und kompatibel zu halten. So lehnte er etwa einen zweiten Hauptprozessor (wie einen Motorola 68000) ab und schlug vor, den 8-Bit-Bereich des Systems strikt vom neuen 16-Bit-Bereich zu trennen. Dieses Konzept floss maßgeblich in die Architektur des IIgs ein.

Das Entwicklerteam bestand aus erfahrenen Apple-II-Spezialisten. Dan Hillman, zuvor technischer Leiter des gescheiterten Apple‑IIx-Projekts, übernahm das Hardware-Engineering und die Integration des neuen Prozessors. Nancy Stark gilt als eine der frühesten und energischsten Fürsprecherinnen des Projekts innerhalb Apples. Curtis Sasaki fungierte als Produktmanager, Ed Colby als Zuständiger für die CPU-Komponenten, und Harvey Lehtman leitete die Entwicklung der Systemsoftware. Weitere wichtige Beiträge kamen von Rob Moore, der die neuen Grafik- und Soundmodi mitdefinierte, sowie von Gus Andrate, der die Sound-Tools und Firmware für Laufwerke entwickelte. Steve Wozniak selbst stand dem Team beratend zur Seite und sein Einfluss zeigte sich auch in symbolischen Details wie der bereits erwähnten Signatur am Gehäuse. Wozniak wird rückblickend mit den Worten zitiert, der neue 65C816-Chip könne in hohen Taktfrequenzen sogar den Macintosh-Prozessor 68000 „in den meisten Anwendungen schlagen“ – eine optimistische Prognose, die allerdings nicht in vollem Umfang Realität wurde.

Prozessor und Leistung: Das Herzstück des Apple IIgs ist der 65C816 mit 16‑Bit-Registern, der im IIgs standardmäßig mit 2,8 MHz getaktet war. Zum Vergleich: Frühere Apple‑II-Modelle nutzten 8-Bit-Chips mit 1 MHz. Tatsächlich war der im IIgs verbaute 65C816 oft für 4 MHz zertifiziert, doch Apple beließ den Takt aus ungeklärten Gründen bei 2,8 MHz. Viel wurde darüber spekuliert, Apple habe die CPU absichtlich gedrosselt, um den Macintosh nicht in Verlegenheit zu bringen. Ob diese Marketing-Theorie stimmt, ist umstritten – Steve Jobs, der ein entschiedener Förderer des Macintosh war, hatte Apple bereits 1985 verlassen. Wahrscheinlicher ist, dass technische Faktoren wie Timing-Probleme mit langsamerer Peripherie ausschlaggebend waren. Ungeachtet der Taktfrequenz bot der 65C816 einen riesigen Schritt nach vorn: Er beherrschte einen 8-Bit-Kompatibilitätsmodus, so dass der IIgs praktisch einen vollständigen Apple IIe emulieren konnte. Die untersten 128 KB des Speichers wurden als sogenanntes Slow RAM implementiert und verhielten sich exakt wie beim Apple II (inklusive der nichtlinearen Speicherorganisation für Text- und Grafikmodus). In diesem Bereich lief auch alte 8-Bit-Software unverändert und sogar zeitgenau – auf Wunsch konnte der Nutzer per Kontrollfeld die Systemgeschwindigkeit von „Normal“ (ca. 1 MHz) auf „Fast“ (2,8 MHz) umschalten. Alles oberhalb dieses Bereichs nutzte den vollen 16-Bit-Modus. Der Hauptspeicher des IIgs war anfangs 256 KB RAM (später 512 KB und ab 1989 sogar 1 MB) und via Speicherkarte auf 8 MB erweiterbar– eine gewaltige Kapazität im Vergleich zu den 128 KB eines Apple IIe. Auf dem Motherboard befand sich zudem der Mega II–Chip, der nahezu die gesamte Logik eines Apple IIe in einem IC vereinte. Diese Apple‑II-kompatible Hardware und die neue CPU arbeiteten Hand in Hand und machten den IIgs zur schnellsten und leistungsfähigsten Apple-II-Variante.

In puncto Video war der Apple IIgs seinen Vorgängern und auch manchem Konkurrenten voraus. Neben allen alten Modi (Text, Hi-Res und Double Hi-Res) führte er einen Super-High-Resolution–Grafikmodus ein. Die maximale Auflösung betrug zwar weiterhin 640 × 200 Bildpunkte (aus Kompatibilitäts- und Kostengründen verzichtete Apple auf höhere Zeilenzahlen), doch erstmals standen 4096 Farben zur Verfügung. Im praxisnahen 320 × 200 Modus konnten pro Bildschirmzeile 16 beliebige Farben aus dieser 12-Bit-Palette dargestellt werden. Durch geschicktes Palette-Switching ließ sich theoretisch eine Grafik mit bis zu 256 Farben gleichzeitig erzeugen, in Spezialfällen sogar bis zu 3200 verschiedenen Farbtönen über den ganzen Bildschirm verteilt. Im hochauflösenden 640 × 200 Modus waren 4 Farben pro Zeile möglich. Diese Fähigkeiten übertrafen den Macintosh jener Zeit, der 1986 nur Schwarz-Weiß-Grafik bot. Auch gegenüber dem Atari ST und Commodore Amiga schlug sich der IIgs wacker – alle drei Systeme boten eine Farbpalette von 4096 Farben. Apple entschied sich bewusst dafür, die Horizontalauflösung zu erhöhen statt die Vertikale, um teure Spezialmonitore zu vermeiden und die Abwärtskompatibilität zu bewahren. Die Grafikadressierung wurde im IIgs endlich linear organisiert, was Programmierern die Arbeit erleichterte (beim Apple II waren Pixel bekanntlich auf verworrene Speicheradressen verteilt). Ein dedizierter Video-Controller-Chip (VGC) mit 32 KB eigenem Bildspeicher sorgte dafür, dass trotz Speicheraufteilung zwei 16-KB-Blöcke als kontinuierlicher Grafikpuffer erschienen. Insgesamt bedeutete der Apple IIgs einen Quantensprung für Apple‑II-Grafik: Farbfotos und aufwändige GUI-Elemente wurden erstmals möglich. Zeitgenössische Stimmen lobten zwar die Grafikqualität, bemängelten aber zugleich, dass man aus Rücksicht auf alte Apple‑II-Programme auf radikale Innovationen verzichtet habe. Das Magazin BYTE kommentierte im Oktober 1986 etwa, die Leistung der IIgs -Designer sei „bemerkenswert, aber die Last der klassischen Apple‑II-Architektur, nun so ehrwürdig (und veraltet) wie COBOL und Stapelverarbeitung, hat sie vielleicht heruntergezogen und ihnen echte Technologiesprünge verwehrt“.

Noch deutlicher stach der Apple IIgs in der Klangausgabe hervor. Apple verbaute einen Ensoniq 5503 Digital Oscillator Synthesizer-Chip – derselbe 8-Bit-Wavetable-Soundchip, den Ensoniq in professionellen Synthesizern wie dem Mirage und ESQ-1 einsetzte. Der Chip, entworfen von Bob Yannes (dem Schöpfer des SID-Chips im Commodore 64), besitzt 32 Oszillatoren und damit bis zu 32 unabhängige Stimmen. Apple koppelte je zwei Oszillatoren zu einem Kanal, wodurch dem System standardmäßig 15 polyphone Stimmen in Stereo zur Verfügung standen. (Ein Kanal wurde zur Takterzeugung reserviert, daher oft die Angabe „15 Stimmen“.) In der Praxis entsprach dies immer noch einer nie dagewesenen Soundfülle für einen Heimcomputer Mitte der 1980er – Nibble schwärmte vom „Traumcomputer“ und merkte an, dass bis auf die niedrigere Geschwindigkeit „nur der IIgs den Macintosh deutlich unterbietet – bei Grafik und Ton übertrifft er ihn sogar“. Tatsächlich galt der Apple IIgs bis in die frühen 90er Jahre hinein als der leistungsfähigste Heimcomputer für Musikapplikationen. Der Ensoniq-Chip verfügte über 64 KB eigenen Sound-RAM für Wavetables und arbeitete größtenteils autonom: Lief im Hintergrund Musik, konnte sie sogar weiterspielen, wenn das Hauptprogramm abstürzte. Ein kleiner Wermutstropfen war, dass Apple aus Kostengründen nur einen monoauralen 3,5‑mm-Kopfhöreranschluss bereitstellte. Der Chip selbst unterstützt Stereoausgabe und Eingabe (A/D-Wandler integriert); entsprechende Drittanbieter-Karten konnten den bereits vorhandenen Stereo-Sound „freischalten“, ohne zusätzliche Chips einzubauen. Für viele Anwender rechtfertigte allein die hochwertige Soundausgabe den Preis des IIgs: „Die Audiofähigkeiten stehen in einer eigenen Klasse... [sie] rechtfertigen den Preis für viele Musikfans“ schrieb Compute! im November 1986.

Äußerlich orientierte sich der Apple IIgs am Design des Apple IIc (flaches, cremefarbenes Gehäuse), war aber größer dimensioniert, da er wieder die klassischen Erweiterungssteckplätze bot. Insgesamt sieben Slots im Gehäuse erlaubten die Nutzung fast aller Karten für Apple II/II+ und IIe – ein deutlicher Vorteil gegenüber den geschlossenen Macintosh-Modellen und auch gegenüber dem kompakteren Apple IIc. Zusätzlich gab es einen internen Speichererweiterungs-Steckplatz, über den bis zu 8 MB RAM nachgerüstet werden konnten. Der IIgs war damit sehr ausbaufreundlich; viele Drittanbieter brachten Beschleunigerkarten (bis 10 MHz+), SCSI-Controller, Sound- und Netzwerkkarten auf den Markt. An externen Schnittstellen besaß der IIgs zwei Diskettenanschlüsse (für 5,25″-und 3,5″-Laufwerke), zwei serielle RS-422-Ports für Drucker, Modem oder Vernetzung, einen Composite-Video-Ausgang (FBAS) für Fernsehmonitore sowie einen Apple-typischen 15-poligen RGB-Monitoranschluss. Bemerkenswert ist, dass der IIgs als erster Computer von Apple den neuen Apple Desktop Bus (ADB) einführte – eine serielle Bus-Schnittstelle zum Anschließen von Tastatur, Maus und anderen Eingabegeräten. (ADB wurde kurz darauf auch beim Macintosh II übernommen und blieb über ein Jahrzehnt Apple-Standard.) Ein kleiner Lautsprecher war wie bei allen Apple II integriert, hauptsächlich für Systemtöne. Maße und Gewicht des Hauptgeräts lagen bei ca. 11,7 × 28,4 × 34,8 cm (H×B×T) und 3,96 kg. Das Netzteil lieferte 60 Watt. An der Geräterückseite befand sich zudem ein Batteriefach für die Pufferbatterie der Echtzeituhr.

Standardmäßig bootete der Apple IIgs von Diskette. Apple lieferte meist ein 800‑KB-3,5″-Laufwerk (Apple 3.5 Drive) mit und unterstützte natürlich auch die älteren 140‑KB-5,25″-Disketten der Vorgänger. Über eine Steckkarte konnte ein SCSI-Festplattenlaufwerk angeschlossen werden, was viele Nutzer in Anspruch nahmen – Apple bot hierfür eine offizielle „Apple II High-Speed SCSI“-Karte an. Auch CD-ROM-Laufwerke ließen sich in den späten 80ern über SCSI anbinden. Dank der cleveren Systemsoftware konnte der IIgs sogar übers Netzwerk starten (booten): Mit einer AppleTalk-Karte (Workstation Card) verhielt sich ein Apple IIgs im AppleShare-Netz wie ein Netzwerk-Boot-Terminal, lange bevor es vergleichbare Funktionen auf dem Mac gab. Dieses Feature, 1988 eingeführt, erlaubte etwa Schulklassen, Software zentral vom Server zu laden, anstatt Disketten zu verteilen. Im Laufe der Jahre erschien diverses externes Speichermedium für den IIgs, von Streamer-Bandlaufwerken bis ZIP‑Disketten, meist durch Dritthersteller – begünstigt durch die offenen Erweiterungs-Slots.

Ausgeliefert wurde der Apple IIgs mit einer erweiterten Version des Apple-II-Betriebssystems ProDOS 16 und einer an den Macintosh angelehnten grafischen Benutzeroberfläche. Tatsächlich war der IIgs der erste Apple-Computer mit einem farbigen Desktop und Fenstersystem – der farbfähige Macintosh II kam erst ein halbes Jahr später auf den Markt. Die IIgs -Oberfläche, anfangs Apple II Desktop genannt, wurde bald zu GS/OS weiterentwickelt. GS/OS kombinierte die Einfachheit von ProDOS mit einer Maussteuerung, Fenstern, Menüs und Icons, die dem Mac-System nachempfunden waren. Apple integrierte ein Kontrollfeld zum Einstellen von Parametern wie Taktfrequenz, Bildschirmfarben, Sound und Peripherie – all das wurde in einer batteriegepufferten RAM-Zelle gespeichert, so dass Nutzerprofile erhalten blieben. Viele Komponenten der Systemsoftware stammten aus der Macintosh-Welt: So half Mac-Entwickler Bill Atkinson bei der Portierung der Grafikroutinen (QuickDraw II) für den IIgs. Die Apple-II-Abteilung und Macintosh-Abteilung waren 1985 zusammengelegt worden, was den Know-how-Transfer erleichterte. Unter der Haube lief auf dem IIgs weiterhin auch das alte ProDOS 8 für 8-Bit-Programme – Apple sorgte dafür, dass nahezu alle Apple‑IIe- und IIc-Programme auf dem IIgs liefen. Der Kompatibilitätsmodus war so umgesetzt, dass auch Timing-trickreiche Software wie Spiele oder Demos funktionierte, notfalls durch Drosseln auf 1 MHz. Für Neuentwicklungen bot GS/OS hingegen moderne APIs, ein Geräte-Treiber-Modell und Unterstützung für größere Massenspeicher. Apple lieferte Systemdisketten mit einem Finder-ähnlichen Datei-Browser, Desktop-Zubehör und dem Installer aus. Spätere Updates (System 5, System 6) verbesserten den IIgs weiter und fügten Funktionen hinzu, die der Mac erst mit System 7 erhielt (z. B. einen eigenständigen Fonts-Ordner für Schriften). Die Weiterentwicklung der Software hielt bis 1993 an und wurde von der treuen Apple‑II-Community aufmerksam verfolgt. Allerdings zeigten sich Schwierigkeiten: Viele Entwickler zögerten, Software exklusiv für den IIgs zu schreiben. Stattdessen passten etliche Hersteller bestehende Apple‑II-Programme nur oberflächlich an (etwa durch Farbgrafik und Mausbedienung), um kein Risiko einzugehen. 1987 berichtete inCider, dass viele Publisher geplante IIgs -Projekte gestoppt hätten und stattdessen weiter für die alten IIe/IIc veröffentlichten. Das wohl populärste Programm auf dem IIgs war daher anfangs ausgerechnet AppleWorks, die Textverarbeitung/Tabelle/DB-Suite, die eigentlich noch für den Apple IIe entwickelt worden war. Leistungsfähige neue IIgs -Anwendungen kamen nur zögerlich auf den Markt. Dieser Mangel an Software bremste die Verbreitung des Systems erheblich – eine Erkenntnis, die Apple letztlich in seiner zukünftigen Strategie bestärken sollte (für den Macintosh achtete man früh darauf, genügend Entwicklerunterstützung zu sichern).

Trotz der zurückhaltenden offiziellen Unterstützung arbeiteten einige Apple-Ingenieure und Drittentwickler weiter daran, den IIgs auszubauen. Apple selbst stellte 1988 die bereits erwähnte Workstation Card vor, um Apple II im Netzwerk zu betreiben. Anschließend begann eine kleine Gruppe, an einer waschechten Ethernet-Karte für den Apple II zu entwickeln – ein damals ungewöhnliches Unterfangen. Erste Prototypen dieser Ethernetkarte nutzten sogar einen eigenen 65C02- bzw. später 65C816-Prozessor auf der Karte und 128 KB ROM für Netzwerk-Boot-Funktionen. Apple kündigte an, die Ethernetkarte 1992 zusammen mit GS/OS 6.0.1 auszuliefern, doch bevor es dazu kam, wurde das Projekt aus wirtschaftlichen Gründen abgebrochen. Noch ambitionierter war der Plan für einen verbesserten Apple IIgs „ROM 04“, Codename Mark Twain. Apple CEO John Sculley erwähnte im Herbst 1988, man arbeite an einem neuen Apple‑II-Modell in den nächsten 12–18 Monaten. Tatsächlich entstand 1990 ein weiterentwickelter IIgs -Prototyp: Er besaß 2 MB RAM auf der Platine (mit SIMM-Steckplätzen für weitere Module), einen auf 8 MHz getakteten 65C816, eingebautes SuperDrive-Diskettenlaufwerk (3,5″ 1,44 MB, kompatibel auch zu MS-DOS-Disketten) und eine interne 40-MB-SCSI-Festplatte. Der Mark-Twain-Entwurf integrierte also vieles, was beim ursprünglichen IIgs noch optional oder extern war, und schaffte den alten Speicherkarten-Slot zugunsten moderner SIMMs ab. Sogar HyperCard IIgs sollte vorinstalliert sein. Auffällig war allerdings, dass die CPU-Geschwindigkeit nicht signifikant erhöht wurde – offenbar wollte Apple die Kompatibilität und Stabilität nicht riskieren. Der Codename Mark Twain spielte augenzwinkernd auf das berühmte Zitat an: „Die Berichte über meinen Tod sind stark übertrieben“. Doch leider fehlte diesem Projekt ein hochrangiger Fürsprecher im Management. 1991 wurde Mark Twain in letzter Minute zurückgezogen und nie offiziell vorgestellt. Nur wenige Prototypen gerieten später in Sammlerhände. Damit blieb der im August 1989 veröffentlichte Apple IIgs „ROM 03“ (eine Revision mit 1 MB Grundspeicher und einigen Firmware-Verbesserungen) die letzte Ausbaustufe, die in den Handel kam.

Technisch war der Apple IIgs zur Einführung ein außergewöhnlich ausgewogener Heimcomputer. Er verband die millionenfache Software-Basis der Apple‑II-Welt mit einem moderaten Preis und modernen Features. Compute! bezeichnete ihn treffend als „zwei Maschinen in einer – ein Produkt, das die Brücke schlägt zwischen dem Macintosh und dem Apple IIe, und damit eine ernsthafte Konkurrenz für den Commodore Amiga und Atari ST darstellen könnte“. In der Praxis stand der IIgs jedoch genau zwischen diesen Welten und hatte Mühe, sich gegen beide Seiten zu behaupten. Gegenüber den Vorgängern Apple IIe/IIc punktete der IIgs mit seiner 16-Bit-Leistung, Farb-GUI, besserer Grafik und Ton und den Erweiterungsmöglichkeiten – doch er war deutlich teurer als ein einfacher IIe und benötigte für viele Aufgaben weiterhin Disketten oder Zubehör, die in Schulen schon vorhanden waren. Manchen Anwendern erschien der IIgs im Alltag kaum schneller, da viele Apple‑II-Programme keine Optimierung für die 16-Bit-CPU hatten und praktisch im alten 1-MHz-Modus liefen. Gleichzeitig war der IIgs nicht ganz auf Augenhöhe mit den Konkurrenten seiner Zeit: Ein Atari 1040ST oder Amiga 500 (beide um 1987 populär) besaßen vollwertige 16/32-Bit-Motorola-CPUs mit 8 MHz und boten ebenfalls Grafik mit 4096 Farben sowie grafikoptimierte Betriebssysteme – und das zu oft niedrigeren Preisen. BYTE verglich Anfang 1987 ein IIgs -System (mit Farbmonitor, zwei Laufwerken, Drucker für ~2.500 $) mit einem Atari-ST-Paket für ~1.500 $ und stellte nüchtern fest, der IIgs sei „in vielen Bereichen eher trailing-edge als leading-edge“ (also Technik von gestern statt Spitze von morgen). Zwar lobte das Magazin die Entscheidung von Apple, überhaupt noch einen modernen Apple II herauszubringen – allerdings wäre dies „ein paar Jahre früher“ besser gewesen und Apple sei „nicht weit genug gegangen“.

Auf der Habenseite standen beim IIgs die fast nahtlose Abwärtskompatibilität (inklusive offizieller Umrüst-Kits, um aus einem Apple IIe einen IIgs zu machen), die massive Software-Bibliothek an 8-Bit-Programmen und Spielen, sowie die enorme Ausbaufähigkeit durch Steckplätze – etwas, das weder der Amiga 500 noch der Atari ST in vergleichbarer Weise boten. Auch der eingebaute Apple Desktop Bus und die AppleTalk-Netzwerkfähigkeit waren Pluspunkte in professionellen Umgebungen. Für Kreative war die Audioqualität des IIgs ein wichtiges Pro-Argument gegenüber anderen Plattformen (die erst Jahre später mit Sampling-Karten vergleichbares boten). Dennoch blieb der IIgs in Benchmarks oft hinterher: 16-Bit-Software wie GS/OS oder Grafikanwendungen liefen zwar, aber nicht so flüssig wie vergleichbare Anwendungen auf den Motorola-68000-Systemen. Diese relative Langsamkeit wurde zum Dauerthema – 1988 drängte Compute! Apple, den Rechner endlich schneller zu machen, „denn egal wie man es dreht – der IIgs ist langsam“. Doch Apple brachte keine Beschleunigung mehr heraus und überließ diese dem Zubehörmarkt (etwa ZIP-GSX-Beschleuniger bis 7 MHz). Ein weiterer Kritikpunkt war der Preis: Durch Aufrüstungen konnte ein voll ausgestatteter IIgs so teuer werden wie ein deutlich leistungsfähigerer Macintosh oder PC, was viele Käufer abschreckte. Außerdem setzte Apple die Prioritäten im Vertrieb klar auf den Macintosh – Apple-Händler wurden angewiesen, Kunden eher zum Mac als zum IIgs zu lenken, mit dem Argument, die Apple-II-Linie werde ohnehin eingestellt. Diese self-fulfilling prophecy schadete den IIgs -Verkäufen zusätzlich.

Erfolg, Verkaufszahlen und Vermächtnis: Trotz aller Vorschusslorbeeren konnte der Apple IIgs den kommerziellen Erwartungen nicht gerecht werden. Apple nannte zwar nie offizielle Stückzahlen, doch interne Quellen beziffern die gesamt verkauften Einheiten auf deutlich unter eine Million. Zum Vergleich: Vom Apple IIe hatte Apple insgesamt über 5 Millionen Stück abgesetzt, vom C64 sogar rund 12–15 Millionen. Anfangs soll die Nachfrage für den IIgs hoch gewesen sein – die ersten 50.000 Geräte waren Berichten zufolge binnen weniger Wochen bestellt. Allerdings verzögerte sich die breite Auslieferung bis November 1986 wegen Problemen mit neuen Custom-Chips. In dieser Zeit kam bereits neue Konkurrenz auf (IBM PC ATs, VGA-Grafikstandards etc.). 1987 brachte Apple den günstigeren Apple IIc Plus heraus, der dem IIgs kannibalisierend gegenüberstand. Gleichzeitig feilte Apple fieberhaft am Macintosh-II-Lineup. Marketingkampagnen für den IIgs blieben spärlich – ein paar Anzeigen in Apple-II-Magazinen, aber keine große Werbeoffensive. Im Bildungsmarkt blieb der robuste Apple IIe noch lange im Einsatz, so dass viele Schulen den teureren IIgs übersprangen. In der Community wurde Apple vorgeworfen, das Potential des IIgs mutwillig brachliegen zu lassen. 1989, gut drei Jahre nach Einführung, war der IIgs laut inCider nur noch der viertschnellste Apple II – hinter einem getunten IIe mit Beschleunigerchip und sogar hinter dem Apple IIc Plus (der mit 4 MHz Takt lief). Apple selbst stellte die Produktion des IIgs schließlich am 4. Dezember 1992 offiziell ein, während der betagte Apple IIe noch bis 1993 als Auftragsprodukt erhältlich war. Zum Abschied veröffentlichte Apple 1993 ein letztes System-Update (GS/OS 6.0.1) im Internet, doch schon zuvor hatte sich die Apple-II-Abteilung praktisch aufgelöst.

Die Frage, ob der Apple IIgs das Unternehmen Apple in eine „neue Richtung“ führte, muss verneint werden. Eher markiert der IIgs den Schlusspunkt einer Ära. Er stellte das technisch Machbare innerhalb der Apple‑II-Architektur eindrucksvoll unter Beweis, konnte Apple jedoch nicht vom strategischen Schwenk auf den Macintosh-Kurs abbringen. Intern war bereits seit Steve Jobs’ Rückzug 1985 klar, dass die Zukunft bei der Macintosh-Plattform liegen sollte. Der IIgs diente primär dazu, der riesigen Apple-II-Anwenderbasis einen sanften Übergang zu ermöglichen und diese noch einige Jahre zu halten. Apple erfüllte dieses Versprechen insofern, als man bestehende Apple‑II-Investitionen der Kunden achtete – etwa durch den später eingeführten Apple IIe-Karten-Einschub für den Macintosh LC, der einem Mac die vollständige Apple‑IIe-Hardware integrierte. Doch ein echter Neubeginn war der IIgs nicht: Er blieb eine Nischenmaschine für Enthusiasten, Heimanwender und Schulen, während Apple parallel mit dem Macintosh II (1987) und dessen Nachfolgern den Markt der leistungsfähigen 32-Bit-Rechner eroberte. Immerhin floss manches Konzept des IIgs in spätere Produkte ein – etwa der ADB-Anschluss oder die Idee farbiger Benutzeroberflächen. Aus historischer Sicht wird der Apple IIgs heute als einzigartiger Hybrid gesehen: „Arguably the finest assemblage of chips and resistors ever soldered together“, lobte das Nibble-Magazin begeistert – „zweifellos eine der feinsten Ansammlungen von Chips und Widerständen, die je zusammengelötet wurden“. Gleichzeitig war er aber auch ein Computer, der zu spät kam und zu wenig unterstützt wurde. Nichtsdestotrotz genießt der Apple IIgs Kultstatus. Er war der letzte Apple, dessen Design noch die Handschrift von Steve Wozniak trug, und für viele Fans bleibt er Woz’ letzter großer Apple II – ein liebevoll entwickeltes System, das den Übergang von der 8-Bit- in die 16-Bit-Welt verkörperte, auch wenn es den Weg des Unternehmens letztlich nicht mehr ändern konnte.

Panzer General, veröffentlicht 1994 von SSI, war ein rundenbasiertes Strategiespiel, das mit seinen hexagonalen Karten zwar keineswegs eine Neuerfindung des Genres darstellte, wohl aber den entscheidenden Schritt wagte, das bis dahin als sperrig geltende Wargame-Genre massentauglich zu machen. In Japan waren Hexfeld-Kriegsspiele längst etabliert: Mit Titeln wie Daisenryaku, das seit 1985 auf Plattformen wie dem MSX oder PC-88 erschien, war das Prinzip bereits fester Bestandteil der dortigen Spielkultur. Auch auf westlichen Konsolen hatte man mit Nectaris (1989, PC-Engine) – später auch bekannt als Military Madness – einen beliebten Vertreter, der Taktik und Zugänglichkeit verband. Doch im Westen galt Hex-Strategie bis dahin als Domäne grauer DOS-Menüs und dicker Handbücher. Panzer General änderte das.

Panzer General, veröffentlicht 1994 von SSI, war ein rundenbasiertes Strategiespiel, das mit seinen hexagonalen Karten zwar keineswegs eine Neuerfindung des Genres darstellte, wohl aber den entscheidenden Schritt wagte, das bis dahin als sperrig geltende Wargame-Genre massentauglich zu machen. In Japan waren Hexfeld-Kriegsspiele längst etabliert: Mit Titeln wie Daisenryaku, das seit 1985 auf Plattformen wie dem MSX oder PC-88 erschien, war das Prinzip bereits fester Bestandteil der dortigen Spielkultur. Auch auf westlichen Konsolen hatte man mit Nectaris (1989, PC-Engine) – später auch bekannt als Military Madness – einen beliebten Vertreter, der Taktik und Zugänglichkeit verband. Doch im Westen galt Hex-Strategie bis dahin als Domäne grauer DOS-Menüs und dicker Handbücher. Panzer General änderte das.

Fiendish Freddy’s Big Top O’ Fun, entwickelt von Gray Matter Inc. unter Leitung von Chris Gray und veröffentlicht 1989 von Mindscape, ist ein grellbuntes, schwarzhumoriges Zirkusspiel, das mit sechs teils brutalen Minispielen in Folge für offene Münder und verkrampfte Joystickhände sorgte. Der Spieler übernimmt die Rolle eines Zirkusdirektors, der versucht, seinen heruntergekommenen Betrieb mit spektakulären Shows vor der endgültigen Schließung zu retten. 10.000 Dollar müssen verdient werden, doch da ist Fiendish Freddy – ein zynischer Saboteur mit Zylinder und Zigarrenschneidern, der nichts lieber tut, als den Artisten das Leben zur Hölle zu machen.

Fiendish Freddy’s Big Top O’ Fun, entwickelt von Gray Matter Inc. unter Leitung von Chris Gray und veröffentlicht 1989 von Mindscape, ist ein grellbuntes, schwarzhumoriges Zirkusspiel, das mit sechs teils brutalen Minispielen in Folge für offene Münder und verkrampfte Joystickhände sorgte. Der Spieler übernimmt die Rolle eines Zirkusdirektors, der versucht, seinen heruntergekommenen Betrieb mit spektakulären Shows vor der endgültigen Schließung zu retten. 10.000 Dollar müssen verdient werden, doch da ist Fiendish Freddy – ein zynischer Saboteur mit Zylinder und Zigarrenschneidern, der nichts lieber tut, als den Artisten das Leben zur Hölle zu machen.

The Goonies, veröffentlicht 1985 in den USA von Datasoft und ein Jahr später in Europa von US Gold, war eine jener frühen Filmumsetzungen, die versuchten, das cineastische Abenteuerfeuerwerk ins pixelige 8‑Bit‑Universum zu übertragen – und das mit erstaunlich viel Charme, obwohl (oder gerade weil) man statt auf actionreiche Dauerballerei auf Puzzle-Kombinationen und Geschicklichkeit setzte. Das Spiel wurde von Scott Spanburg programmiert, der später noch durch Bruce Lee und Zorro auffiel, während Kelly Day die Grafik entwarf und Richard Mirsky (Apple II, Atari) sowie John A. Fitzpatrick (C64) sich um die Musik kümmerten – letztere teils mit eigenständigen Tape‑ und Diskettenversionen, was zur damaligen Zeit noch echte Unterschiede bedeutete.

The Goonies, veröffentlicht 1985 in den USA von Datasoft und ein Jahr später in Europa von US Gold, war eine jener frühen Filmumsetzungen, die versuchten, das cineastische Abenteuerfeuerwerk ins pixelige 8‑Bit‑Universum zu übertragen – und das mit erstaunlich viel Charme, obwohl (oder gerade weil) man statt auf actionreiche Dauerballerei auf Puzzle-Kombinationen und Geschicklichkeit setzte. Das Spiel wurde von Scott Spanburg programmiert, der später noch durch Bruce Lee und Zorro auffiel, während Kelly Day die Grafik entwarf und Richard Mirsky (Apple II, Atari) sowie John A. Fitzpatrick (C64) sich um die Musik kümmerten – letztere teils mit eigenständigen Tape‑ und Diskettenversionen, was zur damaligen Zeit noch echte Unterschiede bedeutete.

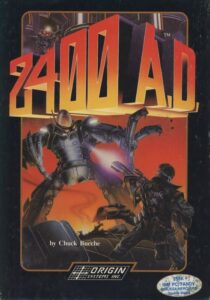

2400 A.D. von Origin Systems war eines dieser Spiele, das mit großen Ambitionen gestartet wurde – und mit einem leisen „bitte vergessen“ im Firmenarchiv endete. Entwickelt von Chuck Bueche, besser bekannt als „Chuckles“, der zuvor als Entwickler bei Ultima I–IV sowie Autoduel tätig war, erschien der Titel 1988 für den Apple II und MS-DOS – und hätte eine neue Sci-Fi-Rollenspielreihe einläuten sollen. Stattdessen wurde er zum Paradebeispiel für verpasste Chancen bei einem eigentlich hochinteressanten Cyberpunk-Konzept.

2400 A.D. von Origin Systems war eines dieser Spiele, das mit großen Ambitionen gestartet wurde – und mit einem leisen „bitte vergessen“ im Firmenarchiv endete. Entwickelt von Chuck Bueche, besser bekannt als „Chuckles“, der zuvor als Entwickler bei Ultima I–IV sowie Autoduel tätig war, erschien der Titel 1988 für den Apple II und MS-DOS – und hätte eine neue Sci-Fi-Rollenspielreihe einläuten sollen. Stattdessen wurde er zum Paradebeispiel für verpasste Chancen bei einem eigentlich hochinteressanten Cyberpunk-Konzept.

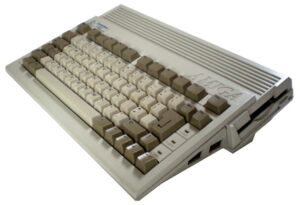

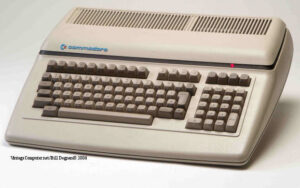

Der Commodore Amiga 600, intern zunächst als Amiga 300 entwickelt, war 1992 Commodores Versuch, einen modernen, kompakteren Heimcomputer für Einsteiger auf den Markt zu bringen. Ursprünglich geplant als günstiger, abgespeckter Amiga 500 für die untere Preisklasse, wurde das Gerät unter dem Projektnamen „June Bug“ (eine Anspielung auf den B-52’s Song, wie auch „Rock Lobster“ beim A500) entwickelt – mit dem Ziel, das Lebensende des Amiga 500 einzuläuten und einen kleinen, kosteneffizienten Amiga für Spiele, Multimedia und Einsteiger zu etablieren. Doch Commodores Management entschied sich in letzter Minute für eine Namensänderung: Statt Amiga 300 sollte das Gerät als Amiga 600 erscheinen, was vielen Kunden suggerierte, es handle sich um einen größeren technischen Sprung. Das Gegenteil war der Fall. David Pleasance, späterer Chef von Commodore UK, beschrieb die Entscheidung rückblickend trocken: „Der Amiga 600 war ein kompletter und absoluter Unsinn – ein Produkt, das niemand wirklich haben wollte.“ In einem Interview mit Retro Gamer ergänzte er: „Das war keine Marktentscheidung, das war ein politisches Manöver. Niemand bei Commodore UK hatte den A600 verlangt – wir wurden damit überrumpelt.“

Der Commodore Amiga 600, intern zunächst als Amiga 300 entwickelt, war 1992 Commodores Versuch, einen modernen, kompakteren Heimcomputer für Einsteiger auf den Markt zu bringen. Ursprünglich geplant als günstiger, abgespeckter Amiga 500 für die untere Preisklasse, wurde das Gerät unter dem Projektnamen „June Bug“ (eine Anspielung auf den B-52’s Song, wie auch „Rock Lobster“ beim A500) entwickelt – mit dem Ziel, das Lebensende des Amiga 500 einzuläuten und einen kleinen, kosteneffizienten Amiga für Spiele, Multimedia und Einsteiger zu etablieren. Doch Commodores Management entschied sich in letzter Minute für eine Namensänderung: Statt Amiga 300 sollte das Gerät als Amiga 600 erscheinen, was vielen Kunden suggerierte, es handle sich um einen größeren technischen Sprung. Das Gegenteil war der Fall. David Pleasance, späterer Chef von Commodore UK, beschrieb die Entscheidung rückblickend trocken: „Der Amiga 600 war ein kompletter und absoluter Unsinn – ein Produkt, das niemand wirklich haben wollte.“ In einem Interview mit Retro Gamer ergänzte er: „Das war keine Marktentscheidung, das war ein politisches Manöver. Niemand bei Commodore UK hatte den A600 verlangt – wir wurden damit überrumpelt.“

Im Dezember 1987 veröffentlichte Microsoft mit Windows 2.0 ein Betriebssystem, das auf den ersten Blick wie eine unspektakuläre Weiterentwicklung wirkte, tatsächlich aber ein entscheidender Meilenstein in der Geschichte grafischer Benutzeroberflächen auf dem PC war. Nach dem mäßigen Erfolg von Windows 1.01, das Ende 1985 erschienen war, erkannte man bei Microsoft schnell, dass man noch einen langen Weg vor sich hatte, um im GUI-Markt Fuß zu fassen. Bill Gates äußerte sich dazu bereits im Frühjahr 1986 in einem internen Memo: „Die grafische Benutzeroberfläche ist die Zukunft. Wir haben es beim ersten Mal nicht richtig gemacht, aber wir können es uns nicht leisten, es nicht noch einmal zu versuchen.“

Im Dezember 1987 veröffentlichte Microsoft mit Windows 2.0 ein Betriebssystem, das auf den ersten Blick wie eine unspektakuläre Weiterentwicklung wirkte, tatsächlich aber ein entscheidender Meilenstein in der Geschichte grafischer Benutzeroberflächen auf dem PC war. Nach dem mäßigen Erfolg von Windows 1.01, das Ende 1985 erschienen war, erkannte man bei Microsoft schnell, dass man noch einen langen Weg vor sich hatte, um im GUI-Markt Fuß zu fassen. Bill Gates äußerte sich dazu bereits im Frühjahr 1986 in einem internen Memo: „Die grafische Benutzeroberfläche ist die Zukunft. Wir haben es beim ersten Mal nicht richtig gemacht, aber wir können es uns nicht leisten, es nicht noch einmal zu versuchen.“ Diese Version nutzte erstmals den „Virtual 8086 Mode“ des 386ers, um mehrere gleichzeitige DOS-Sitzungen in voneinander isolierten Speicherbereichen auszuführen – ein Vorläufer heutiger Virtualisierung. Die Entwickler bei Microsoft bezeichneten das Feature intern scherzhaft als „multiboxing“. In einer späteren Pressemitteilung beschrieb Microsoft diese Fähigkeit als „den bedeutendsten Fortschritt im PC-Multitasking seit der Erfindung des Timesharing-Systems.“

Diese Version nutzte erstmals den „Virtual 8086 Mode“ des 386ers, um mehrere gleichzeitige DOS-Sitzungen in voneinander isolierten Speicherbereichen auszuführen – ein Vorläufer heutiger Virtualisierung. Die Entwickler bei Microsoft bezeichneten das Feature intern scherzhaft als „multiboxing“. In einer späteren Pressemitteilung beschrieb Microsoft diese Fähigkeit als „den bedeutendsten Fortschritt im PC-Multitasking seit der Erfindung des Timesharing-Systems.“ So konnte zum Beispiel ein in Write eingefügter Wert aus einer Excel-Tabelle automatisch aktualisiert werden – eine Funktion, die später als OLE (Object Linking and Embedding) weiterentwickelt wurde.

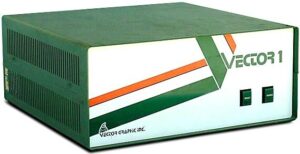

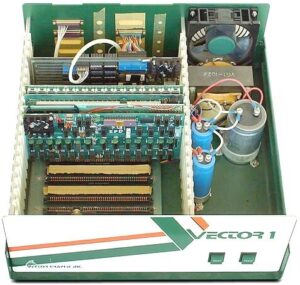

So konnte zum Beispiel ein in Write eingefügter Wert aus einer Excel-Tabelle automatisch aktualisiert werden – eine Funktion, die später als OLE (Object Linking and Embedding) weiterentwickelt wurde. Im Jahr 1976, als der Begriff "Personal Computer" noch mit Schraubenzieher und Lötzinn gleichgesetzt wurde, gründeten Lore Harp McGovern, Carole Ely und Robert Harp im sonnigen Kalifornien das Unternehmen Vector Graphic Inc. Die Vision: nicht nur leistungsfähige Computer zu bauen, sondern auch solche, die benutzerfreundlich und optisch ansprechend waren. Während Harp als Ingenieur die technische Leitung übernahm, trieb Harp McGovern als CEO die strategische Entwicklung voran. Ihre Mission war klar: Technik aus dem Bastelkeller in den Büroalltag zu bringen. Mit Mut zur Farbe, strukturiertem Design und klarem Fokus auf Bedienbarkeit stach Vector Graphic schnell aus der damaligen Nerd-Nische heraus.

Im Jahr 1976, als der Begriff "Personal Computer" noch mit Schraubenzieher und Lötzinn gleichgesetzt wurde, gründeten Lore Harp McGovern, Carole Ely und Robert Harp im sonnigen Kalifornien das Unternehmen Vector Graphic Inc. Die Vision: nicht nur leistungsfähige Computer zu bauen, sondern auch solche, die benutzerfreundlich und optisch ansprechend waren. Während Harp als Ingenieur die technische Leitung übernahm, trieb Harp McGovern als CEO die strategische Entwicklung voran. Ihre Mission war klar: Technik aus dem Bastelkeller in den Büroalltag zu bringen. Mit Mut zur Farbe, strukturiertem Design und klarem Fokus auf Bedienbarkeit stach Vector Graphic schnell aus der damaligen Nerd-Nische heraus. 1977 stellte das Unternehmen schließlich diesen Vector 1 vor – einen S-100-Bus-basierten Mikrocomputer, der für professionelle Anwendungen gedacht war und die rohe Bastelästhetik des Altair 8800 oder IMSAI 8080 hinter sich ließ. In einem robusten Metallgehäuse, erhältlich in den Farben Grün oder "Rust", steckte ein Intel 8080A-Prozessor mit 2 MHz, gepaart mit einem Kilobyte RAM. Das klang nach wenig – war aber über den S-100-Bus, dem damals führenden Industriestandard, auf bis zu 64 KB erweiterbar. Der S-100-Bus, ursprünglich von MITS für den Altair entwickelt, war ein Steckplatzsystem mit 100 Kontakten, über die CPU-, Speicher- und Peripheriekarten miteinander kommunizierten. Vector Graphic nutzte dieses System voll aus und stattete den Vector 1 mit bis zu 18 dieser Slots aus – eine Plattform, die mit dem Unternehmen und den Anforderungen der Nutzer wachsen konnte.

1977 stellte das Unternehmen schließlich diesen Vector 1 vor – einen S-100-Bus-basierten Mikrocomputer, der für professionelle Anwendungen gedacht war und die rohe Bastelästhetik des Altair 8800 oder IMSAI 8080 hinter sich ließ. In einem robusten Metallgehäuse, erhältlich in den Farben Grün oder "Rust", steckte ein Intel 8080A-Prozessor mit 2 MHz, gepaart mit einem Kilobyte RAM. Das klang nach wenig – war aber über den S-100-Bus, dem damals führenden Industriestandard, auf bis zu 64 KB erweiterbar. Der S-100-Bus, ursprünglich von MITS für den Altair entwickelt, war ein Steckplatzsystem mit 100 Kontakten, über die CPU-, Speicher- und Peripheriekarten miteinander kommunizierten. Vector Graphic nutzte dieses System voll aus und stattete den Vector 1 mit bis zu 18 dieser Slots aus – eine Plattform, die mit dem Unternehmen und den Anforderungen der Nutzer wachsen konnte.