Jay Miner

Wenn es einen Menschen gibt, der als Vater, als Schöpfer einer ganzen Computerserie gilt, dann ist dies mit Sicherheit Jay Miner, der Vater des Amiga. Seinen Lebenslauf zu schreiben ist nur möglich, wenn man seinen Blick auch auf die Geschichte seines Unternehmens Amiga, Inc. richtet. 1932 in Prescott, Arizona geboren, zog er schon bald mit seiner Familie nach Kalifornien und besuchte dort später die Universität von Berkeley. Zuvor jedoch leistete Jay seinen Dienst bei der amerikanischen Küstenwache, die sein Talent für Elektronik erkannte und ihn in eine Schule für Elektronik überstellte, die in Groton, Connecticut, lag. In diesem Umfeld lernte er seine zukünftige Frau Caroline Poplawski kennen, die er schon kurze Zeit später heiratete. Die Dienstzeit von drei Jahren verging, dank Heirat, relativ schnell, und Caroline zog mit ihrem Mann zurück nach Kalifornien, um sein Studium zu beginnen. 1959 schloss er dieses mit einem Bachelor of Science in Electrical Engineering and Computer Science erfolgreich ab. Dies ermöglichte ihm in den 1960ern, bei zahlreichen Unternehmen und Firmen anzufangen, aber auch das Glück mit eigenen Startups zu versuchen. Unter anderem entwickelte er einen ferngesteuerten Herzschrittmacher. Probleme hatte Miner jedoch mit seiner eigenen Gesundheit: die Funktion seiner Nieren war eingeschränkt und Jay verbrachte viel Zeit an Dialysegeräten. Allerdings schien dieses Problem ihn nicht weiter aufzuhalten, und in den nächsten Jahren entwarf er mitunter einen der ersten digitalen Voltmeter und Taschenrechner und war seiner Zeit damit voraus.

Harold M. Lee erkannte das Potenzial und lud ihn zu Atari ein, wo er sofort eine Festanstellung erhielt. Das erste Projekt war der Television Interface Adapter, kurz TIA, der den Grundstein zum Atari VCS 2600 bilden sollte. Atari selbst hatte zuvor mit den ersten Pong-Automaten ein Vermögen gemacht und vertrieb auch schon seit einiger Zeit Wohnzimmerversionen ihres Spielautomaten. Der Markt schien allerdings gesättigt zu sein, und ein logischer Schritt war demnach, ein Modell zu entwickeln, das dem Anwender ermöglichte, die Spiele auszutauschen und somit immer neue Anwendungen zu erleben. Jedoch kam Ataris Entwicklungsabteilung einfach nicht weiter, und erst Jays Mithilfe versprach Erfolg. Bisher besaß Atari lediglich eine Steckplatine voller Funktionen, die aber in dieser primitiven Weise nicht eingesetzt werden konnte. Jay setzte sich an das Problem und vereinte sämtliche Funktionen in einem Chip, den er TIA taufte. Mit seiner Hilfe und einer kurzen Zeit des Debuggings war das Problem gelöst, und Atari konnte das VCS 2600 auf den Markt bringen, das zu einem unglaublichen Erfolg und Beginn der modernen Computerspielindustrie wurde. Eine bekannte Anekdote sei hier erwähnt: Jay arbeitete nie allein, stets war seine engste „Mitarbeiterin“ dabei – sein Cockapoo Mitchy. Mitchy hatte sogar ein eigenes Namensschild an der Tür. Allerdings war Mitchy natürlich nicht wirklich „entscheidungsbefugt“ im technischen Sinne – Jay selbst erzählte gerne augenzwinkernd, dass er seinen Hund um Rat fragte und bei Missfallen das Konzept sofort verwarf. Diese Anekdote unterstreicht jedoch vor allem Jays humorvollen Umgang mit seiner Arbeit.

Das gemeinsame Entwicklungsteam bastelte in der Folgezeit an den weiterführenden Entwürfen des TIA, die später in den 8-Bit-Computern des Unternehmens arbeiten sollten. Jay entwarf dafür den ANTIC-Chip (Alphanumeric Television Interface Controller), der 1981 patentiert wurde. ANTIC beherrschte 14 unterschiedliche Modi zur Darstellung von Text und Grafik und unterstützte den MOS 6502 Prozessor bei der Datenverarbeitung. Im weitesten Sinne konnte man ihn als grafischen Coprozessor bezeichnen. Miners Vorarbeiten führten zusätzlich auch zum CTIA, der die verarbeiteten Grafiken und Texte an den Monitor ausgab. Der ANTIC verblieb bis 1986 in sämtlichen 8-Bit-Modellen des Unternehmens. Dies spricht wohl für sein vorzügliches Design, das keine Änderungen notwendig machte. Allerdings muss man hierbei auch erwähnen, dass Jay seine Entwürfe noch per Hand auf Papier brachte und so beschrieb, dass wohl nur er die Skizzen wirklich verstehen konnte. Nachfolgende Bearbeitungen durch Dritte waren kaum möglich.

Allerdings war Jay Miner nicht sonderlich glücklich, denn er interessierte sich für die neuen Motorola 68000 Prozessoren, die auf reiner 16-Bit-Basis arbeiteten. Jay fragte bei Atari nach, ob er einen Computer entwickeln dürfe, der auf diesem Chip basierte. Atari selbst war nicht sonderlich begeistert: die Entwicklung des Atari 800 hatte enorme Summen verschlungen, und das Unternehmen sah keinen Sinn in einem Computer, dessen Prozessor bereits 100 Dollar kostete, von den Kosten für den Arbeitsspeicher ganz zu schweigen. Der Motorola 68000 Prozessor benötigte die doppelte Menge an Speicher, was eben auch die Kosten verdoppelte. Diese uneinsichtige Einstellung der Führung, die die Zeichen der Zeit nicht verstanden, enttäuschte Miner gewaltig, und kurzerhand kündigte er seine Zusammenarbeit 1982 auf. Stattdessen unterschrieb er bei einem Unternehmen für Herzschrittmacher und Medizintechnik (Xymos). Die Entwicklung seines 16-Bit-Konzeptes entwickelte er dieser Zeit jedoch weiter, allerdings zumeist in Details, denn das Grundkonzept war bereits fertig entwickelt.

Ein paar Jahre früher, 1979, entschied sich auch Larry Kaplan, über seine Zukunft bei Atari nachzudenken. Gemeinsam mit ein paar weiteren Entwicklern war er über die Bezahlung nicht sonderlich erfreut und gründete Activision. Zwei Jahre später verließ er auch Activision wieder, um neue Projekte zu verfolgen. Jay Miner hingegen ging einen anderen Weg: er überzeugte Xymos, in die Produktion von Chips für ein neues Computersystem einzusteigen. Mit Investorenunterstützung entstand daraus Hi-Toro, das schon bald in Amiga, Inc. umbenannt wurde. Jay Miner wurde zum Vizepräsidenten und technischen Leiter. Anfangs wollte man mit Hi-Toro eine Spielkonsole entwickeln, die jedoch jederzeit zu einem echten Computer ausgebaut werden konnte. Diese Vision teilte Jay, auch wenn es anfangs nicht an die große Glocke gehängt wurde, da die Marktchancen für Computer damals als riskant galten.

Ein paar Jahre früher, 1979, entschied sich auch Larry Kaplan, über seine Zukunft bei Atari nachzudenken. Gemeinsam mit ein paar weiteren Entwicklern war er über die Bezahlung nicht sonderlich erfreut und gründete Activision. Zwei Jahre später verließ er auch Activision wieder, um neue Projekte zu verfolgen. Jay Miner hingegen ging einen anderen Weg: er überzeugte Xymos, in die Produktion von Chips für ein neues Computersystem einzusteigen. Mit Investorenunterstützung entstand daraus Hi-Toro, das schon bald in Amiga, Inc. umbenannt wurde. Jay Miner wurde zum Vizepräsidenten und technischen Leiter. Anfangs wollte man mit Hi-Toro eine Spielkonsole entwickeln, die jedoch jederzeit zu einem echten Computer ausgebaut werden konnte. Diese Vision teilte Jay, auch wenn es anfangs nicht an die große Glocke gehängt wurde, da die Marktchancen für Computer damals als riskant galten.

Jay Miner zog schließlich nach Santa Clara, um sein eigenes Computerprojekt zu realisieren. Allerdings stellte Miner klare Forderungen: er erhielt ein monatliches Gehalt, ein Aktienpaket und seine persönliche Assistentin – Mitchy. Die Hundedame erhielt vollen Zutritt zu den Räumen des Unternehmens. Eine Klausel besagte, dass ihre Zutrittsberechtigung jederzeit wieder entzogen werden konnte, falls sich Mitarbeiter gestört fühlen sollten – was jedoch nie passierte, da Mitchy bei den Mitarbeitern sehr beliebt war. Jay war dieser Punkt sehr wichtig, er brauchte Mitchy um sich, um sich bei seiner Arbeit wohlzufühlen. Dies lockerte und beruhigte ihn, sodass er sich voll auf seine Arbeit konzentrieren konnte.

Bevor jedoch auch nur die erste Steckplatine begonnen wurde, verließ Larry Kaplan die Firma bereits wieder. Jay Miner wurde im selben Augenblick Vizepräsident eines Unternehmens, das bisher nur auf dem Papier existierte. Die Projektentwicklung lag nun völlig in seinen Händen. Auch ein Name wurde nun benötigt, und man einigte sich schließlich auf „Amiga, Inc.“. Jay selbst war zu Beginn überhaupt nicht begeistert über den Namen, korrigierte aber schon bald seine Meinung. Er glaubte zunächst, dass ein spanisches Wort bei den potenziellen Käufern falsche Assoziationen wecken könnte, doch letztlich erkannte er, dass der Name leicht einprägsam war und für eine freundliche, positive Zukunft stand.

Im Laufe der Monate wuchs das Entwicklungsteam für den Prototypen „Lorraine“ (benannt nach der Ehefrau des Unternehmenspräsidenten) stetig an. Jay Miner suchte nicht nur nach fähigen Entwicklern, sondern nach Menschen, die mit Leidenschaft hinter dem Projekt standen. Dabei tolerierte er auch unkonventionelle Eigenheiten. Einige Mitarbeiter trugen violette Strumpfhosen oder Plüschhasen-Slipper – Exzentrik war bei Amiga Inc. Teil der Unternehmenskultur und förderte ein familiäres Arbeitsklima.

Dale Luck, der Grafikspezialist des Unternehmens, war äußerlich kaum als solcher zu erkennen und erinnerte eher an einen Hippie der späten 1960er-Jahre. Für Jay zählte jedoch nur das Ergebnis. Solange die Arbeit erledigt wurde, ließ er seinen Mitarbeitern freie Hand. Dies führte dazu, dass einige tagelang von zu Hause aus arbeiteten, ohne im Büro zu erscheinen. Miner betonte: „Den Mitarbeitern zu gestatten, anders zu sein, ist ungemein wichtig.“

Die Richtung des neuen Systems war zunächst nicht klar definiert. RJ Mical, ein Soft- und Hardwareentwickler, plädierte für ein kostengünstiges Modell, das als Konkurrenz zum Atari VCS 2600 positioniert werden sollte. Diese Meinung teilten auch die Investoren, die ihr Kapital für ein solches Produkt bereitgestellt hatten. Dale Luck und Carl Sassenrath hingegen forderten eine Maschine mit umfangreichen Erweiterungsmöglichkeiten. Diese Grundsatzdiskussion war bis zur Veröffentlichung des Amiga nicht endgültig entschieden.

Amiga Inc. hatte jedoch kreative Methoden, um Meinungsverschiedenheiten zu lösen. Schaumstoff-Baseballschläger wurden bereitgestellt, mit denen Konflikte spielerisch ausgetragen wurden. Nach solchen „Schlachten“ wurde wieder konzentriert weitergearbeitet. Die Mitarbeiter waren hochmotiviert, da sie wussten, dass sie an einem der aufregendsten Computer ihrer Zeit arbeiteten. Die Softwareentwicklung war besonders engagiert und hatte ihre Vorgaben bereits fertiggestellt, bevor die Hardwareentwickler den ersten Grafikchip entworfen hatten.

Ein Betriebssystem fehlte jedoch noch. Carl Sassenrath erhielt die Aufgabe, ein echtes Multitasking-System zu entwickeln, aus dem schließlich „Exec“ entstand. Er erinnerte sich: „Ich wurde als Betriebssystemingenieur eingestellt. Beim Vorstellungsgespräch sagte Bob Pariseau, ich könne das so machen, wie ich wollte. Also sagte ich: Schön! Ich möchte ein multitaskingfähiges System entwickeln.“

Jay Miner strebte einen Computer an, der dem späteren Amiga 2000 ähnelte und dem Anwender umfangreiche Ausbaumöglichkeiten bot. Die grafischen Fähigkeiten sollten ebenfalls fortschrittlich sein. Miner begann, sich mit den Aufgaben eines Blitters zu beschäftigen – ein Begriff, der für „Block Image Transfer“ steht und in der Computerwelt seit den frühen Modellen der Firma Xerox bekannt war. Der Blitter sollte Daten innerhalb des RAM schnell bewegen oder modifizieren, ohne den Hauptprozessor zu beanspruchen.

Miner kontaktierte seinen Freund Ron Nicholson, der Interesse an dieser Aufgabe zeigte und sich dem Team anschloss. Während einiger Brainstorming-Sitzungen wurden weitere Funktionen für den Blitter und andere Chips diskutiert. Dale Luck bat beispielsweise um eine „Line Drawing“-Funktion, die zuvor nicht vorgesehen war. Obwohl Miner zunächst keine Zeit dafür hatte, implementierte er die Funktion schließlich doch noch vor der bevorstehenden CES.

Insgesamt benötigte das Team zwei Jahre, um die Custom-Chips des Amiga zu entwerfen, während die Softwareabteilung an den Amiga-Libraries und den Grundfunktionen arbeitete. Da die Hardware größtenteils nur als Steckplatinen existierte, war eine präzise Beschreibung der Funktionen entscheidend. Die Ingenieure mussten genaue Registereinträge mitteilen, damit der Programmcode korrekt auf die Hardware zugreifen konnte.

Der erste Prototyp sah weit weniger imposant aus als der endgültige Amiga 1000. Das System bestand aus zahlreichen Steckplatinen, die die Custom-Chips simulierten und mit vielen Kabeln verbunden waren. Allein der Agnus-Chip bestand aus 24 Steckplatinen mit jeweils bis zu 250 Chips. Auch Paula und Denise benötigten ähnlichen Platz und trugen damals noch die Namen Daphne und Portia. Je mehr Platinen hinzugefügt wurden, desto schwieriger wurde die Gewährleistung der Funktionssicherheit.

Um Industriespionage zu vermeiden, entwickelte Amiga Inc. Peripheriegeräte für bestehende Computer und Konsolen, wie das Joyboard. Für die Konkurrenz sah Amiga Inc. wie ein gewöhnlicher Dritthersteller aus, der Joysticks produzierte, und war daher nicht weiter interessant. Ein Überbleibsel dieser Zeit ist die „Guru Meditation“, eine Fehlermeldung des Amiga-Systems. Das Joyboard war ein Joystick, auf dem der Spieler stehen konnte, um einen Cursor zu steuern. Wenn Programmierer an der Beseitigung von Bugs arbeiteten, setzten sie sich mit gekreuzten Beinen auf das Joyboard, was an einen meditierenden Guru erinnerte. Carl Sassenrath bemerkte später: „Das war unsere Antwort auf die Macintosh-Fehlermeldungen.“

Um Industriespionage zu vermeiden, entwickelte Amiga Inc. Peripheriegeräte für bestehende Computer und Konsolen, wie das Joyboard. Für die Konkurrenz sah Amiga Inc. wie ein gewöhnlicher Dritthersteller aus, der Joysticks produzierte, und war daher nicht weiter interessant. Ein Überbleibsel dieser Zeit ist die „Guru Meditation“, eine Fehlermeldung des Amiga-Systems. Das Joyboard war ein Joystick, auf dem der Spieler stehen konnte, um einen Cursor zu steuern. Wenn Programmierer an der Beseitigung von Bugs arbeiteten, setzten sie sich mit gekreuzten Beinen auf das Joyboard, was an einen meditierenden Guru erinnerte. Carl Sassenrath bemerkte später: „Das war unsere Antwort auf die Macintosh-Fehlermeldungen.“

Intern begann man mit der Entwicklung eines Mainboards, das die Customchip-Steckplatinen aufnehmen konnte. Jay Miner nahm diese frühe Entwicklungsstudie mitsamt einiger Demoprogramme mit auf die CES-Messe im Januar 1984. Vor ausgesuchtem Fachpublikum, darunter Mitarbeiter von Sony, Philips, Hewlett Packard und Apple, führte er seine Maschine vor. Um die Leistungsfähigkeit zu demonstrieren, entwickelten die mitgereisten Amiga-Mitarbeiter auf der Messe die berühmte „Bouncing Ball“-Demo. Diese zeigte einen springenden Ball, dessen Aufprallgeräusch von Bob Parasseau aufgenommen und per Apple II digitalisiert wurde.

Trotz des beeindruckenden Auftritts auf der CES blieb der erhoffte Geldsegen aus. Amiga Inc. sah sich gezwungen, Hypotheken aufzunehmen, um die Gehälter der rund 20 Mitarbeiter zu bezahlen. Jay Miner belastete sogar sein eigenes Haus mit einer Hypothek. In dieser prekären Situation wandte er sich an seinen ehemaligen Arbeitgeber Atari, der mittlerweile von Jack Tramiel geführt wurde.

Er wandte sich an seinen alten Arbeitgeber Atari, angeführt durch Jack Tramiel, einem gewieften Manager, der auch schmutzige Tricks anwandte, wenn seine Position dadurch gebessert wurde. Dieser musste zuvor Commodore, eine Firma, die er selbst gegründet hatte, verlassen und sah mit dem Aufkauf von Atari die Chance seinem alten Unternehmen die Stirn zu bieten. Tramiel und sein Unternehmen gewährten Jay einen Kredit über 500.000 $, die allerdings an eine Klausel gebunden war. Jack Tramiel selbst hatte über den neuen Amiga Computer erfahren und war seinerseits daran interessiert diesen seinem Unternehmen einzuverleiben. Eine Klausel besagte allerdings, dass beide Firmen innerhalb eines Monats einen Vertrag abschließen müssten. Sollte keine Einigung erzielt werden, wäre Amiga verpflichtet, die Summe sofort zurückzuzahlen.

Jack Tramiel bot daraufhin an, Amiga für einen Dollar pro Aktie zu kaufen. Als Amiga dies ablehnte, senkte Tramiel sein Angebot auf 85 Cent pro Aktie. In letzter Minute erfuhr Commodore von der Situation und bot 4,25 US-Dollar pro Aktie. Commodore übernahm Amiga Inc. für insgesamt 24 Millionen US-Dollar. Jay Miner äußerte später: „Es war mein größtes Bedauern, dass wir nicht von Anfang an IBM ins Visier genommen haben. IBM war damals im PC-Markt sehr verwundbar.“

Jack Tramiel war außer sich – er sah sich um die Chance gebracht, einen neuen Computer präsentieren zu können, der Commodore sicher Schwierigkeiten bereitet hätte. Sein altes Unternehmen, Commodore, hatte jedoch erkannt, dass es etwas bekommen hatte, das mehr wert war als die reinen Chipsätze: Sie hatten die Entwickler selbst gewonnen, die den Amiga auch in Zukunft vorantreiben konnten. Zwar verfügten auch Commodores eigene Ingenieure über großes Know-how, aber das Amiga-Team war eingespielt und stand geschlossen hinter seinem Anführer Jay Miner. Deshalb unterstellte man Jay und sein Team keiner bestehenden Abteilung, sondern ließ sie zunächst weiterarbeiten wie zuvor.

Doch der Einfluss des neuen Eigentümers war unübersehbar. Jay Miner hatte zwar immer noch die Kontrolle über die technische Entwicklung, aber der Vorstand begann allmählich, eigene Vorstellungen einzubringen. Zunächst war es eine kleine Designänderung: Der Commodore-Präsident wollte das Keyboard in das Gehäuse einschiebbar haben, um Platz auf dem Tisch zu sparen. Für sich genommen eine Kleinigkeit, doch diese Änderung erforderte eine komplette Neugestaltung des Mainboards, was die Markteinführung um volle zwölf Monate verzögerte.

Als diese Hürde genommen war, verlangte Commodore, dass der Amiga nicht mehr als 256 KByte Speicher benötigte. Grund dafür waren die hohen RAM-Preise Anfang der 1980er-Jahre. Jay Miner widersprach entschieden: „Ich habe immer gesagt, dass Speicher billig ist – wenn auch nicht unbedingt im Preis, so doch im Verhältnis zur Leistungsfähigkeit des Systems“, erinnerte sich Dave Needle später. Jay wusste, dass die geplante Grafikleistung diesen Speicherplatz benötigte, und „erfand“ immer neue Probleme, die eine Reduzierung unpraktikabel machen würden.

Dieses Problem kannte Jay bereits: Schon beim Atari 2600-Nachfolger, als der Videospielmarkt zusammengebrochen war, wollten Investoren den Rechner mit nur 64 KByte ausstatten. Jay konnte damals wenigstens 128 KByte durchsetzen und die Hardware so gestalten, dass der Speicher später aufgerüstet werden konnte. Nun stand er erneut vor diesem Streitpunkt. Dave Needle hatte schließlich die Idee, einen Erweiterungsport in den Amiga 1000 zu integrieren, der Speichermodule aufnehmen konnte. Needle erklärte später: „Jay war strikt dagegen, aber ich wusste, dass wir so wenigstens den Speicher später ausbauen konnten.“

Jay Miner glaubte, das Thema sei mit einem Machtwort geklärt, nahm sich eine Auszeit und war sich sicher, dass keine Änderungen mehr kommen würden. Doch während seines Urlaubs reichte Dave Needle seinen Vorschlag an den Vorstand weiter – und Commodore akzeptierte ihn. Als Jay zurückkehrte, stand er fassungslos vor der Entscheidung, die ihm monatelange Mehrarbeit bescherte. „Wir haben damit wieder sechs Monate verloren, und als es fertig war, waren die RAM-Preise längst gefallen – ironischerweise hätte der ursprüngliche Speicher gar nicht so viel gekostet“, erinnerte sich RJ Mical.

Auch RJ Mical selbst war in dieser Zeit selten im Büro zu sehen. „Ich habe einfach gearbeitet, Tag und Nacht, um die Benutzeroberfläche fertigzustellen“, erzählte er später. Jay gab ihm freie Hand, und so entwickelte Mical fast im Alleingang das grafische Betriebssystem-Interface.

Der Amiga war schließlich fertig. Jay und sein Team mussten zwar mit einigen Kompromissen leben, aber das war immer noch besser, als wenn Atari den Amiga in seine Einzelteile zerpflückt hätte. Die größte Kontroverse blieb die RAM-Größe: Auch die Softwareabteilung kämpfte für 512 KByte, doch der Vorstand ließ sich nicht mehr umstimmen. Der Erweiterungssteckplatz war ebenfalls heftig umkämpft – ursprünglich sollte er oben auf dem Gehäuse liegen, um Erweiterungen wie bei Apple platzieren zu können. Aus Kostengründen einigte man sich schließlich auf seitliche Erweiterungen.

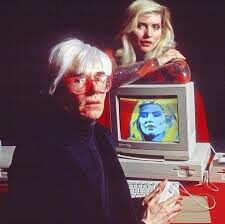

Der Amiga 1000 wurde trotz allem ein Traumcomputer. Bei der Premiere in New York, gemeinsam mit Debbie Harry (Blondie) und Andy Warhol, zeigte das System eindrucksvoll seine Fähigkeiten. Das ursprüngliche Amiga-Team wusste, dass es nun entscheidend war, Entwickler und Händler direkt zu unterstützen, damit das System weiterwachsen konnte. Commodore jedoch hielt daran fest, wichtige Erweiterungen selbst zu entwickeln und den Großteil der Gewinne einzustreichen. Daher verbot das Management eine Erweiterung des Teams und begann sogar, Personal abzuziehen.

Der Amiga 1000 wurde trotz allem ein Traumcomputer. Bei der Premiere in New York, gemeinsam mit Debbie Harry (Blondie) und Andy Warhol, zeigte das System eindrucksvoll seine Fähigkeiten. Das ursprüngliche Amiga-Team wusste, dass es nun entscheidend war, Entwickler und Händler direkt zu unterstützen, damit das System weiterwachsen konnte. Commodore jedoch hielt daran fest, wichtige Erweiterungen selbst zu entwickeln und den Großteil der Gewinne einzustreichen. Daher verbot das Management eine Erweiterung des Teams und begann sogar, Personal abzuziehen.

Jay Miner versuchte noch, Commodore zu überzeugen, dass der Amiga 1000 nicht das Ende sein dürfe und eine Version mit senkrechten Steckplätzen ein professionelleres System ergeben würde. Doch Commodore hatte angesichts der geringen Verkaufszahlen wenig Interesse. „Der Amiga war einfach zu teuer und wurde falsch vermarktet“, sagte RJ Mical. Commodore hatte das System, das aus der Videospielwelt stammte, als Businesscomputer vermarkten wollen – ein fataler Fehler, denn der Amiga war in erster Linie ein Multimedia-Computer.

Nicht nur strategische Fehler von Commodore machten die Situation schwer. Auch der Vorstand störte sich zunehmend an den exzentrischen Eigenheiten der Entwickler. „Es war nicht mehr wie früher – immer mehr Einschränkungen, immer weniger Freiheit“, erinnerte sich Dale Luck. Die Hippie-Ära des Amiga-Teams war endgültig vorbei.

Allerdings erkannte Commodore schon bald, dass der Amiga in seiner damaligen Form keine Chance auf dem Markt hatte, und begann in zwei Abteilungen parallel an einer Low-Cost- und einer High-End-Maschine zu arbeiten. Jay Miner war begeistert von der Richtung, die man nun mit dem Amiga 2000 einschlug. Endlich war es möglich, den Computer nach seinen eigenen Vorstellungen zu erweitern – eine Philosophie, die schon dem Apple II zum Erfolg verholfen hatte. Jay entwickelte zusätzlich ein automatisches Konfigurationssystem für die Steckplätze, das den Einsatz von Treiberdateien überflüssig machen sollte. Doch wie schon bei vielen seiner Ideen zuvor war der Vorstand wenig begeistert, weil dies die Herstellungskosten um 50 Cent pro Gerät erhöht hätte. Jay Miner hatte jedoch einen wichtigen Verbündeten: Rick Geiger, den Abteilungsleiter, der stets zwischen Jay und dem Vorstand vermittelte. Geiger schirmte Jay und sein Team vor vielen Forderungen der Unternehmensführung ab.

Allerdings musste Jay auch Zugeständnisse machen und Elemente einbauen, die Commodore verlangte. Dazu gehörte auch die angestrebte MS-DOS-Kompatibilität, die Geiger versprochen hatte, ohne sie wirklich umsetzen zu können. Jay war nie ein Freund dieser Idee. Wie er selbst einmal sagte: „Ich wollte keinen Clone bauen. Ich wollte, dass der Amiga besser ist.“ Er betonte immer wieder, dass der Amiga als eigenständiger und überlegener Computer konzipiert war – allein schon durch sein fortschrittliches Betriebssystem, das deutlich benutzerfreundlicher war als MS-DOS. Schließlich erschien mit dem Sidecar eine externe Hardwarelösung für PC-Kompatibilität – jedoch ohne Jays Beteiligung. Diese stellte sich als interessanter Ansatz heraus, war aber fehleranfällig und wenig erfolgreich.

Weitaus problematischer war, dass die lange Entwicklungsphase das Interesse von Drittanbietern schwächte. Der Amiga war zu teuer, wenige konnten ihn sich leisten, und viele angekündigte Zusatzgeräte ließen auf sich warten. Entwickler begannen sich anderweitig zu orientieren und wandten sich zunehmend PCs und Apple-Rechnern zu – ein herber Rückschlag für Jays Traum. Commodore verlor die Geduld und forderte die Entwickler auf, in ein neues Entwicklungsbüro an der Ostküste zu wechseln. Die Mannschaft lehnte dies ab, was nicht verwunderlich war: Kalifornien war das Herz der digitalen Innovation, hier standen die Fertigungsstätten, hier konnte man mit den neuesten Techniken arbeiten. Schließlich löste Commodore das gesamte Amiga-Entwicklungsteam in Los Gatos auf. Jay Miner konnte es nicht fassen, dass ein so gut eingespieltes Team auseinandergerissen wurde. Die Geburtsstätte des Amigas war Geschichte. Zwar erhielten alle weiterhin Verträge, aber nur noch als Berater – und auch das nur befristet.

Zusätzlich trug die verfehlte Werbung nicht zum Erfolg des Amigas bei; stattdessen übernahm der PC immer stärker die weltweite Führung. Jay Miner fühlte sich wie ein Vater, dessen Kind nicht den erhofften Weg gehen konnte. „Ich habe immer an das geglaubt, was wir da geschaffen haben“, erinnerte sich RJ Mical später. „Jay war das Herz des Projekts – er hat nie aufgehört, für seine Vision zu kämpfen.“

Als die Produktion des Amiga 500 und Amiga 2000 anlief, entwickelte Jay weitere Chips für die Amiga-Reihe, um deren Fähigkeiten zu erweitern. Grundlegende Ideen davon wurden im sogenannten „erweiterten Chipsatz“ (ECS) umgesetzt, der später im Amiga 500+ und Amiga 3000 Verwendung fand. Doch Jay wurde immer unzufriedener mit den vertraglichen Bedingungen und dem zunehmenden Druck von Commodore. Das Unternehmen entfernte sich immer weiter von seiner ursprünglichen Philosophie – Jay erkannte, dass Commodore nun nur noch den Profit im Blick hatte, nicht den Geist der Maschine. Wie Jay einmal sagte: „Commodore hat uns vor Atari gerettet, aber sie sind mit der Zeit genau wie Atari geworden.“

Schließlich zog er 1989 die Konsequenzen und wechselte zu Ventitrex, einem biotechnologischen Unternehmen in Sunnyvale, wo er an einem Defibrillator arbeitete. Das sollte das letzte Gerät sein, das Jay Miner entwickelte – seine Nieren begannen immer schlechter zu arbeiten. 1990 spendete ihm seine Schwester Joyce Beers eine Niere, die ihm noch vier weitere Jahre schenkte.

Auch in dieser Zeit blieb Jay dem Amiga eng verbunden. Er besuchte Messen, sprach offen seine Meinung und scheute nicht davor zurück, Missstände anzusprechen. Beispielsweise kritisierte er den Einbau einer IDE-Festplatte im Amiga 4000 als Rückschritt gegenüber der zuvor eingesetzten SCSI-Technologie. „Die Soundfähigkeiten sind seit Jahren gleich geblieben – das hätte ich gern verbessert gesehen“, sagte Jay einmal.

Wer Jay Miner kannte, wusste, dass er sich leidenschaftlich für seine Visionen einsetzte. Er war immer offen für Fragen und inspirierte viele. Doch am 20. Juni 1994 versagten seine Nieren endgültig – der Vater des Amiga-Computers fand seine letzte Ruhe. Nur wenige Entwickler haben ein so großes Vermächtnis hinterlassen. RJ Mical erinnerte sich später: „Jay war ein leiser Revolutionär – jemand, der immer das Beste wollte, selbst wenn es unbequem war.“

Der Lucas Nascom 1 war ein britischer Einplatinen-Computerbausatz, der im November 1977 eingeführt wurde. Die grundsätzliche Entwicklungs-Idee kam ursprünglich von einer US-amerikanischen Firma namens Nasco, die jedoch speziell an den englischen Markt dachte, als sie mit John Marshall und Kerr Borland von Nascom Microcomputers kooperierte. Entwickelt wurde er schließlich von Chris Shelton, dessen Ziel es war, einen erschwinglichen Computer für Elektronikbegeisterte zu schaffen. Mit einem Preis von £197,50 (inflationsbereinigt etwa 1.590 € im Jahr 2025) war der Nascom 1 deutlich günstiger als zeitgenössische Modelle wie der Commodore PET oder der Apple II. Das Herzstück des Nascom 1 war ein Zilog

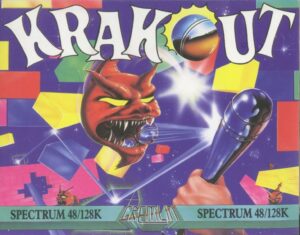

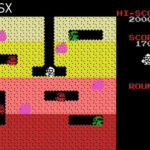

Der Lucas Nascom 1 war ein britischer Einplatinen-Computerbausatz, der im November 1977 eingeführt wurde. Die grundsätzliche Entwicklungs-Idee kam ursprünglich von einer US-amerikanischen Firma namens Nasco, die jedoch speziell an den englischen Markt dachte, als sie mit John Marshall und Kerr Borland von Nascom Microcomputers kooperierte. Entwickelt wurde er schließlich von Chris Shelton, dessen Ziel es war, einen erschwinglichen Computer für Elektronikbegeisterte zu schaffen. Mit einem Preis von £197,50 (inflationsbereinigt etwa 1.590 € im Jahr 2025) war der Nascom 1 deutlich günstiger als zeitgenössische Modelle wie der Commodore PET oder der Apple II. Das Herzstück des Nascom 1 war ein Zilog  „Krakout“, veröffentlicht 1987 von Gremlin Graphics, ist ein bemerkenswerter Vertreter des Breakout-Genres, der durch seine horizontale Ausrichtung und innovative Spielmechaniken auffällt. Entwickelt wurde das Spiel von Andy Green und Rob Toone, mit Grafiken von Terry Lloyd und Musik von Ben Daglish. Daglish, bekannt für seine Arbeiten an Titeln wie „The Last Ninja“ und „Deflektor“, trug maßgeblich zur Atmosphäre des Spiels bei. Er war Teil des Duos W.E.M.U.S.I.C. („We Make Use of Sound in Computers“) und arbeitete eng mit Tony Crowther zusammen.

„Krakout“, veröffentlicht 1987 von Gremlin Graphics, ist ein bemerkenswerter Vertreter des Breakout-Genres, der durch seine horizontale Ausrichtung und innovative Spielmechaniken auffällt. Entwickelt wurde das Spiel von Andy Green und Rob Toone, mit Grafiken von Terry Lloyd und Musik von Ben Daglish. Daglish, bekannt für seine Arbeiten an Titeln wie „The Last Ninja“ und „Deflektor“, trug maßgeblich zur Atmosphäre des Spiels bei. Er war Teil des Duos W.E.M.U.S.I.C. („We Make Use of Sound in Computers“) und arbeitete eng mit Tony Crowther zusammen.

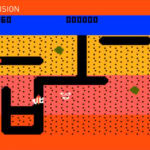

„Dig Dug“, veröffentlicht 1982 von Namco, zählt zu den Ikonen der goldenen Ära der Videospiele und hat sich mit seinem einzigartigen Spielkonzept, seinen charmanten Charakteren und einer überraschenden Tiefe weltweit in das Gedächtnis der Spieler eingebrannt. Die Entwicklung begann 1981, als Masahisa Ikegami gemeinsam mit Shigeru Yokoyama, bekannt als Schöpfer von „Galaga“, an dem Projekt arbeitete. Die Programmierung lag in den Händen von Shouichi Fukatani und Toshio Sakai, während Yuriko Keino für die Musik verantwortlich zeichnete. Sie entschied sich für eine eingängige Melodie, da realistische Schrittgeräusche technisch schwer umsetzbar waren, wie sie später in einem Interview sagte: „Ich wollte, dass sich die Bewegung lebendig anfühlt, ohne dass es aufgesetzt wirkt.“ Für die visuellen Aspekte war Hiroshi „Mr. Dotman“ Ono zuständig, ein Pionier der Pixelkunst, der das farbenfrohe und unverwechselbare Design von „Dig Dug“ prägte.

„Dig Dug“, veröffentlicht 1982 von Namco, zählt zu den Ikonen der goldenen Ära der Videospiele und hat sich mit seinem einzigartigen Spielkonzept, seinen charmanten Charakteren und einer überraschenden Tiefe weltweit in das Gedächtnis der Spieler eingebrannt. Die Entwicklung begann 1981, als Masahisa Ikegami gemeinsam mit Shigeru Yokoyama, bekannt als Schöpfer von „Galaga“, an dem Projekt arbeitete. Die Programmierung lag in den Händen von Shouichi Fukatani und Toshio Sakai, während Yuriko Keino für die Musik verantwortlich zeichnete. Sie entschied sich für eine eingängige Melodie, da realistische Schrittgeräusche technisch schwer umsetzbar waren, wie sie später in einem Interview sagte: „Ich wollte, dass sich die Bewegung lebendig anfühlt, ohne dass es aufgesetzt wirkt.“ Für die visuellen Aspekte war Hiroshi „Mr. Dotman“ Ono zuständig, ein Pionier der Pixelkunst, der das farbenfrohe und unverwechselbare Design von „Dig Dug“ prägte.

Der Fujitsu FM-7, auch bekannt als „Fujitsu Micro 7“, wurde im November 1982 als kostengünstiger Heimcomputer eingeführt und war eine vereinfachte Version des

Der Fujitsu FM-7, auch bekannt als „Fujitsu Micro 7“, wurde im November 1982 als kostengünstiger Heimcomputer eingeführt und war eine vereinfachte Version des  Ist denn schon ein Vierteljahrhundert vergangen? Im Jahr 2000 stellte nämlich Logitech die iFeel MouseMan vor und bot damit eine der ersten Computer-Mäuse, die haptisches Feedback integrierten. Er wurde im Herbst 2000 vorgestellt und kombinierte optische Präzision mit der Fähigkeit, taktile Rückmeldungen zu geben. Diese Innovation basierte auf der TouchSense-Technologie von Immersion Corp., die es ermöglichte, physische Empfindungen wie Vibrationen zu erzeugen, wenn der Mauszeiger über bestimmte Bildschirmobjekte bewegt wurde. Ziel war es, die Benutzererfahrung durch den zusätzlichen Sinneseindruck des Tastsinns zu bereichern.

Ist denn schon ein Vierteljahrhundert vergangen? Im Jahr 2000 stellte nämlich Logitech die iFeel MouseMan vor und bot damit eine der ersten Computer-Mäuse, die haptisches Feedback integrierten. Er wurde im Herbst 2000 vorgestellt und kombinierte optische Präzision mit der Fähigkeit, taktile Rückmeldungen zu geben. Diese Innovation basierte auf der TouchSense-Technologie von Immersion Corp., die es ermöglichte, physische Empfindungen wie Vibrationen zu erzeugen, wenn der Mauszeiger über bestimmte Bildschirmobjekte bewegt wurde. Ziel war es, die Benutzererfahrung durch den zusätzlichen Sinneseindruck des Tastsinns zu bereichern.

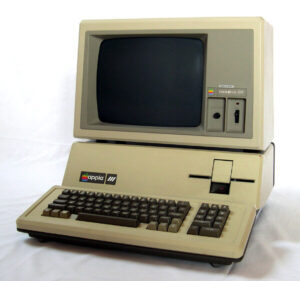

Als Apple im Mai 1980 den Apple III vorstellte, galt er als ambitioniertes Vorhaben, das den erfolgreichen Apple II beerben und das Unternehmen aus dem Heimcomputersegment in den lukrativeren Markt für Business-Computer führen sollte. Die Erwartungen waren immens, denn Apple hatte sich mit dem Apple II als führender Hersteller in der Bildungs- und Hobbyszene etabliert, doch um Unternehmen wie IBM und DEC herauszufordern, musste ein professionelleres Gerät entstehen – leistungsfähiger, robuster und mit echtem Betriebssystem. Der Apple III wurde somit von Anfang an als Business-Maschine positioniert, mit höherem Arbeitsspeicher, besseren Textdarstellungsfähigkeiten und einem professionelleren Gehäuse. Doch die Realität entwickelte sich anders: Der Apple III wurde später berüchtigt als eines der größten Technikdesaster der frühen Computerindustrie.

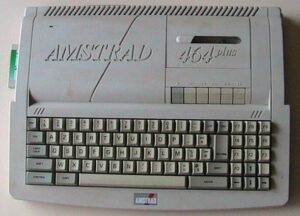

Als Apple im Mai 1980 den Apple III vorstellte, galt er als ambitioniertes Vorhaben, das den erfolgreichen Apple II beerben und das Unternehmen aus dem Heimcomputersegment in den lukrativeren Markt für Business-Computer führen sollte. Die Erwartungen waren immens, denn Apple hatte sich mit dem Apple II als führender Hersteller in der Bildungs- und Hobbyszene etabliert, doch um Unternehmen wie IBM und DEC herauszufordern, musste ein professionelleres Gerät entstehen – leistungsfähiger, robuster und mit echtem Betriebssystem. Der Apple III wurde somit von Anfang an als Business-Maschine positioniert, mit höherem Arbeitsspeicher, besseren Textdarstellungsfähigkeiten und einem professionelleren Gehäuse. Doch die Realität entwickelte sich anders: Der Apple III wurde später berüchtigt als eines der größten Technikdesaster der frühen Computerindustrie. Als der Amstrad CPC 464+ im Jahr 1990 auf den Markt kam, war der Heimcomputermarkt bereits im Umbruch. 16-Bit-Maschinen wie der Commodore Amiga 500 und der Atari ST hatten längst die Fantasie der Entwickler und Spieler erobert, und der klassische 8-Bit-Markt schrumpfte rapide. Dennoch entschloss sich Amstrad unter der Leitung von Sir Alan Sugar dazu, der erfolgreichen CPC-Reihe ein letztes, modernisiertes Update zu verpassen – als Teil einer neuen Generation von Produkten, die mit dem GX4000-Spielsystem eine gemeinsame Hardwarebasis teilen sollten. Der CPC 464+ wurde als direkter Nachfolger des beliebten

Als der Amstrad CPC 464+ im Jahr 1990 auf den Markt kam, war der Heimcomputermarkt bereits im Umbruch. 16-Bit-Maschinen wie der Commodore Amiga 500 und der Atari ST hatten längst die Fantasie der Entwickler und Spieler erobert, und der klassische 8-Bit-Markt schrumpfte rapide. Dennoch entschloss sich Amstrad unter der Leitung von Sir Alan Sugar dazu, der erfolgreichen CPC-Reihe ein letztes, modernisiertes Update zu verpassen – als Teil einer neuen Generation von Produkten, die mit dem GX4000-Spielsystem eine gemeinsame Hardwarebasis teilen sollten. Der CPC 464+ wurde als direkter Nachfolger des beliebten  Der Amstrad CPC (Colour Personal Computer), eine Heimcomputer-Serie aus Großbritannien, wurde 1984 von Amstrad unter der Leitung von Alan Michael Sugar veröffentlicht. Die Serie war Amstrads Antwort auf die Dominanz von Commodore, Sinclair und Acorn im britischen Heimcomputermarkt der frühen 1980er Jahre. Sugar, ein britischer Unternehmer aus einfachen Verhältnissen, hatte sich bis dahin mit billigen Stereoanlagen und Haushaltsgeräten einen Namen gemacht. Mit dem CPC wollte er in den expandierenden Heimcomputermarkt einsteigen, allerdings mit einer radikal anderen Herangehensweise: statt einem nackten Motherboard wie beim Sinclair

Der Amstrad CPC (Colour Personal Computer), eine Heimcomputer-Serie aus Großbritannien, wurde 1984 von Amstrad unter der Leitung von Alan Michael Sugar veröffentlicht. Die Serie war Amstrads Antwort auf die Dominanz von Commodore, Sinclair und Acorn im britischen Heimcomputermarkt der frühen 1980er Jahre. Sugar, ein britischer Unternehmer aus einfachen Verhältnissen, hatte sich bis dahin mit billigen Stereoanlagen und Haushaltsgeräten einen Namen gemacht. Mit dem CPC wollte er in den expandierenden Heimcomputermarkt einsteigen, allerdings mit einer radikal anderen Herangehensweise: statt einem nackten Motherboard wie beim Sinclair